Zur Version ohne Bilder

freiesMagazin Juli 2015

(ISSN 1867-7991)

Debian GNU/Linux 8.0 „Jessie“

Knapp zwei Jahre hat das Debian-Projekt unermüdlich gearbeitet, um den Nachfolger von Debian 7.0 „Wheezy“ fertigzustellen. Dieser Artikel stellt Debian 8.0 „Jessie“ mit einem Fokus auf die Neuheiten dieser Version vor. (weiterlesen)

Mit LaTeX zum E-Book

E-Book-Reader und mobile Geräte, auf denen man E-Books lesen kann, werden immer beliebter, nehmen sie doch weniger Platz in der Reisetasche weg als herkömmliche Bücher. Und so haben auch immer mehr Autoren, die LaTeX nutzen, Interesse daran, ihre Werke nicht nur als PDF, sondern auch in einem E-Book-Format zu veröffentlichen. Der Artikel wirft einen Blick auf die aktuellen Möglichkeiten, ein LaTeX-Dokument in ein EPUB zu konvertieren. (weiterlesen)

cut out selected fields of each line of a file

Ein klassisches Programm im Unix-Werkzeugkasten ist cut. In keinem ordentlichen Tutorial zur Shellprogrammierung fehlt es, denn es ist ein schönes, praktisches und anschauliches Helferlein. Hier soll ein wenig hinter seine Fassade geschaut werden. (weiterlesen)

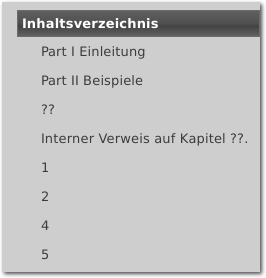

Zum Inhaltsverzeichnis

Linux allgemein

Debian GNU/Linux 8.0 „Jessie“

Linux-Distributionen mit Langzeitunterstützung (LTS)

Der Juni im Kernelrückblick

Anleitungen

Mit LaTeX zum E-Book

Software

Neues in Octave 4.0.0

cut out selected fields of each line of a file

Community

Rezension: Git – Verteilte Versionsverwaltung für Code und Dokumente

Rezension: Let's Play Minecraft: Dein Praxis-Guide

Rezension: The Art of Unit Testing

Magazin

Editorial

Leserbriefe

Veranstaltungen

Vorschau

Konventionen

Impressum

Zum Inhaltsverzeichnis

Wikimedia stellt auf HTTPS um

Die Wikimedia Foundation hat auf ihrem Blog

angekündigt [1],

in naher Zukunft alle normalen HTTP-Verbindungen durch eine mit HTTPS

abgesicherte Version zu ersetzen. Bisher musste man Wikipedia-Seiten manuell

über das HTTPS-Protokoll aufrufen (alle Wikipedia-Links in freiesMagazin sind

beispielsweise explizit mit https:// versehen) oder Plug-ins wie HTTPS

Everywhere [2] verwenden. Mit der

Umstellung soll dieser Umweg entfallen.

Zusätzlich soll HSTS (HTTP Strict Transport

Security [3])

dafür sorgen, dass Proxys und andere dazwischengeschaltete Server nicht doch

eine unsichere Verschlüsselung erzwingen können, um so z. B. die Verbindung

mitlesen zu können.

Spielen unter Linux

Mehr als ein Jahr ist es nun her, dass Crytek im Rahmen der GDC 2014 eine

Linux-Unterstützung für seine als „CryEngine“ bekannte Spiele-Engine

ankündigte [4].

Mitte Juni wurde die CryEngine in Version 3.8.1 freigegeben, die nun laut

Entwickler-Blog die Linux-Unterstützung

mitbringt [5],

was zu einer Reihe großer Spiele-Titel für Linux führen dürfte, auf die man

gespannt warten darf.

Das ewige Sommerloch

Wahrscheinlich wird der ein oder andere Leser wieder auf das Thema „Sommerloch“

gewartet haben. Im Gegensatz zu den Vorjahren sind wir aber bislang noch recht

gut mit Artikeln für die kommenden Ausgaben ausgestattet. Falls Sie aber in einer lauen Sommernacht einmal Langeweile bekommen sollten oder es Sie ganz einfach schon immer in den Fingern gejuckt hat, einen Artikel für freiesMagazin über

Ihr Lieblingsprogramm zu schreiben, schicken Sie uns doch einfach eine E-Mail

an  mit Ihrer Idee bzw. Ihrem Artikelentwurf.

Die Palette an

Themen, die noch nicht behandelt wurden, ist

groß [6], sodass zumindest rein

thematisch die Ideenkiste nicht so schnell leer ist.

Und nun wünschen wir Ihnen viel Spaß mit der neuen Ausgabe.

Ihre freiesMagazin-Redaktion

Links

mit Ihrer Idee bzw. Ihrem Artikelentwurf.

Die Palette an

Themen, die noch nicht behandelt wurden, ist

groß [6], sodass zumindest rein

thematisch die Ideenkiste nicht so schnell leer ist.

Und nun wünschen wir Ihnen viel Spaß mit der neuen Ausgabe.

Ihre freiesMagazin-Redaktion

Links

[1] https://blog.wikimedia.org/2015/06/12/securing-wikimedia-sites-with-https/

[2] https://www.eff.org/https-everywhere

[3] https://en.wikipedia.org/wiki/HTTP_Strict_Transport_Security

[4] http://www.cryengine.com/news/cryengine-adds-linux-support-and-new-possibilities-at-gdc

[5] http://www.cryengine.com/news/update-from-the-team-cryengine-381-is-here-adding-opengl-linux-and-oculus-rift-support

[6] http://www.freiesmagazin.de/artikelwuensche

Beitrag teilen Beitrag kommentieren

Zum Inhaltsverzeichnis

von Hans-Joachim Baader

Knapp zwei Jahre hat das Debian-Projekt unermüdlich gearbeitet, um den

Nachfolger von Debian 7.0 „Wheezy“ fertigzustellen. Dieser Artikel stellt

Debian 8.0 „Jessie“ mit einem Fokus auf die Neuheiten dieser Version vor.

Redaktioneller Hinweis: Der Artikel „Debian GNU/Linux 8.0“ erschien erstmals

bei Pro-Linux [1].

Vorwort

Debian GNU/Linux bezeichnet sich als „das universelle Betriebssystem“ und

ist zweifellos die größte Distribution, sowohl von der Entwickler- als auch

der Anwenderzahl, die unabhängig von einem Unternehmen entwickelt wird.

Debian steht auf eigenen Füßen und bildet die Basis für viele weitere

Distributionen, insbesondere Ubuntu. Mehrere sehr große Installationen wie

das System der Münchner Stadtverwaltung oder das der spanischen Provinz

Extremadura beruhen auf Debian.

Die neue Version 8.0 „Jessie“ wurde, wie bereits mehr als ein Jahr zuvor

festgelegt worden war, Anfang November eingefroren. Das bedeutet, dass bis

zur Veröffentlichung im April nur noch Korrekturen vorgenommen werden

durften. Die Stabilisierungsphase wurde mit fünf Monaten Dauer recht zügig

durchlaufen – und doch bedeutet das, dass sich Debian allein für die

Stabilisierung fast

soviel Zeit gönnte wie andere Distributionen für einen

ganzen Entwicklungszyklus.

Die lange Freeze-Phase führt dazu, dass keine in Debian vorhandene Software

jünger als fünf Monate ist. Doch wie viele Pakete findet ein

durchschnittlicher Benutzer veraltet und möchte sie im Laufe der zwei Jahre

vor dem Erscheinen der nächsten Debian-Version aktualisieren? Vielleicht ein

Dutzend, aber das hängt natürlich davon ab, was man mit dem Rechner alles

macht. Um eine neuere als die angebotene Version zu bekommen, gibt es genug

Möglichkeiten. Auf der Habenseite steht dagegen, dass man den Aufwand der

Aktualisierung nur alle zwei Jahre einmal einplanen muss. Seit Debian nun

auch verlängerten Support erhält, kann man die Distributionen Debian 6

„Squeeze“, Debian 7 „Wheezy“ und auch Debian 8 sogar fünf Jahre lang nutzen.

Wie beschreibt man nun ein System, das auf diversen eigenen Rechnern,

insbesondere den Desktopsystemen, bereits seit Monaten läuft? Die Antwort

lautet »virtuelle Maschinen«. In diesen kann man auf einfache Weise ein

unverändertes System zeigen. Für den Artikel werden daher zwei identische

virtuelle Maschinen (eine für GNOME,

eine für KDE), 64 Bit, unter KVM mit

jeweils 2 GB RAM verwendet.

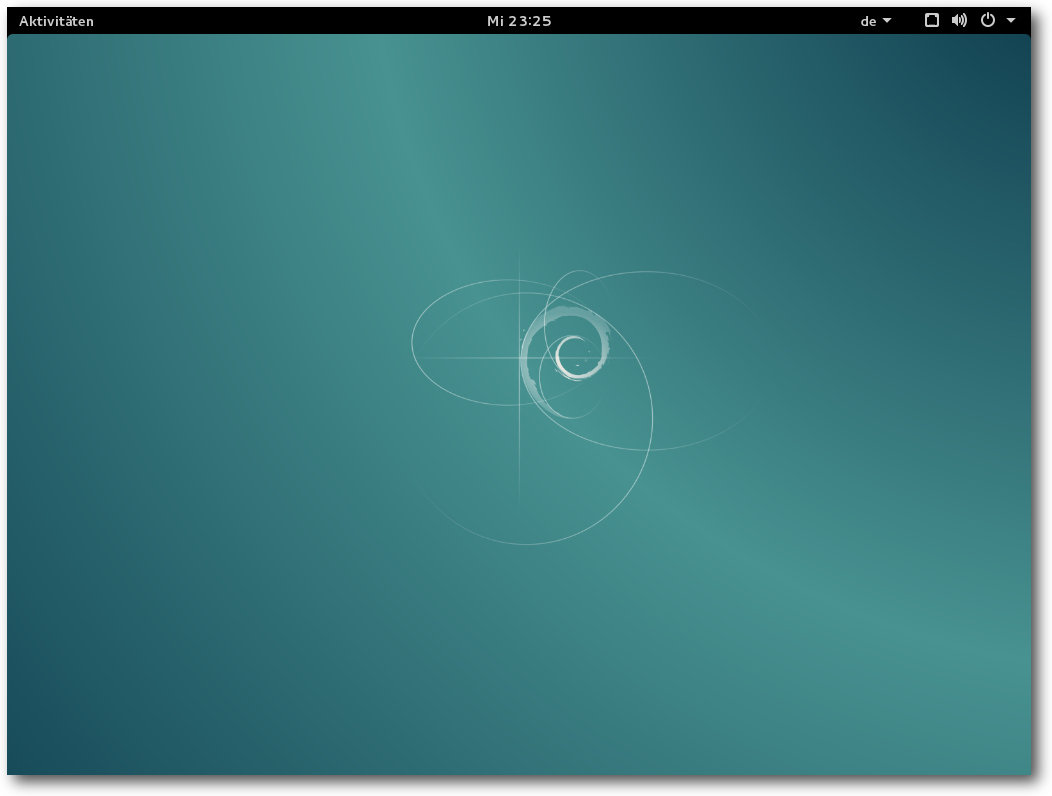

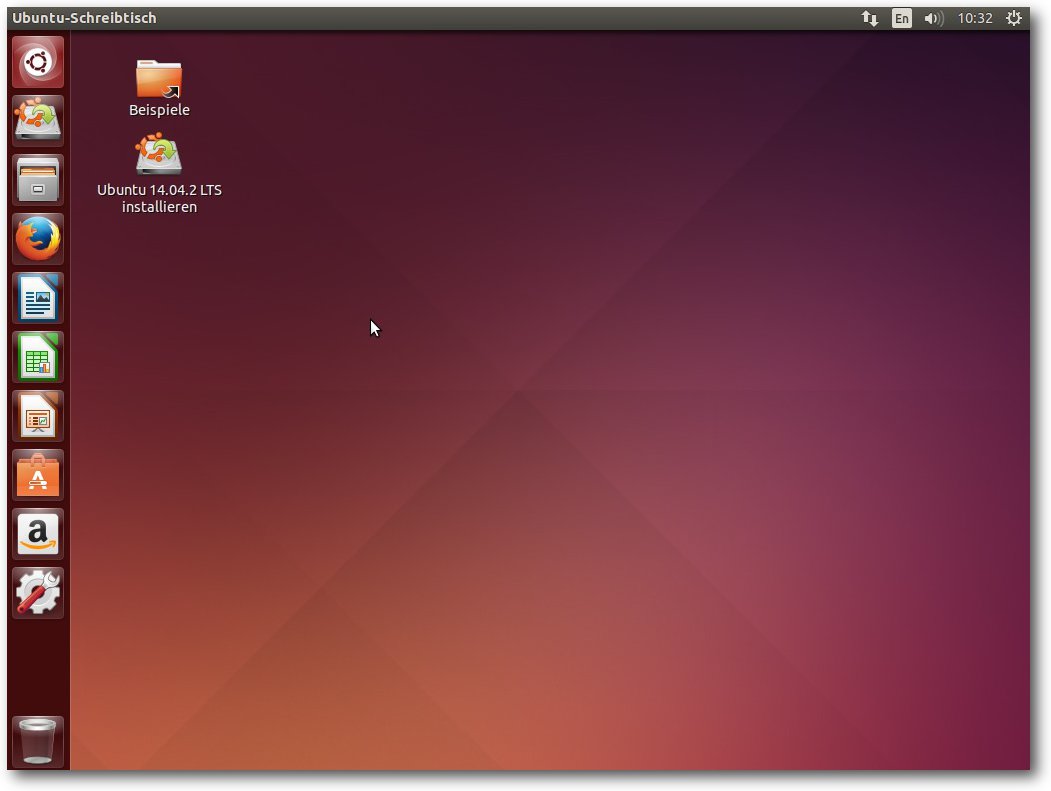

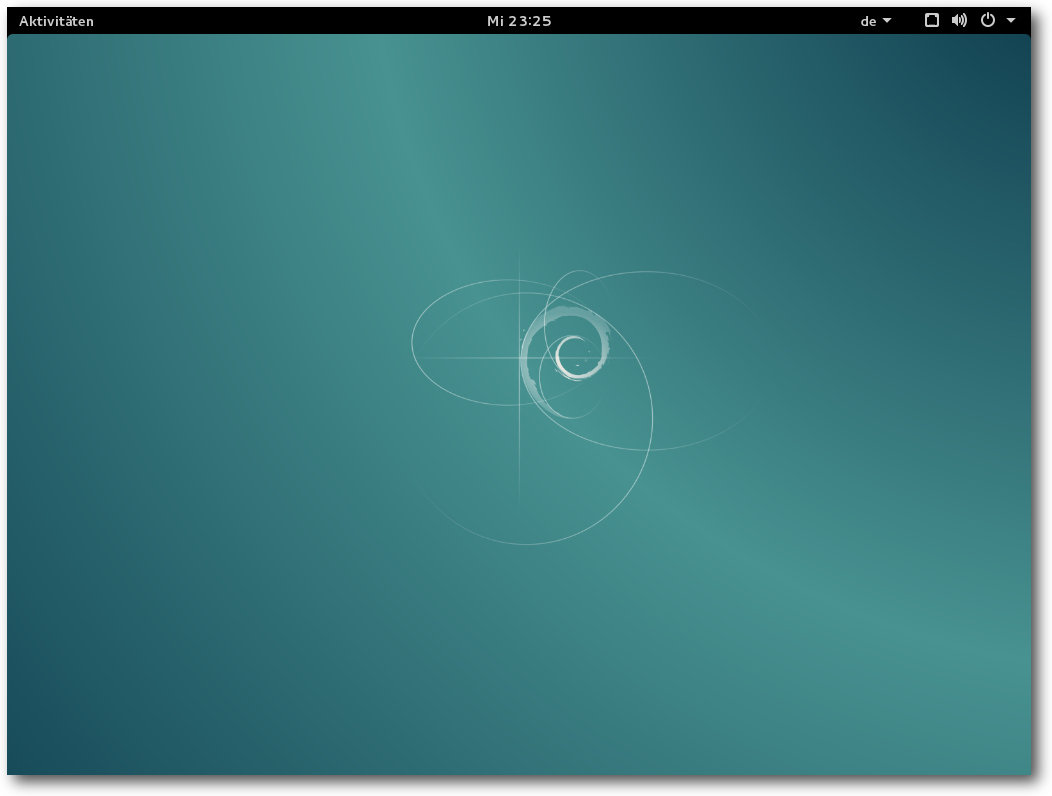

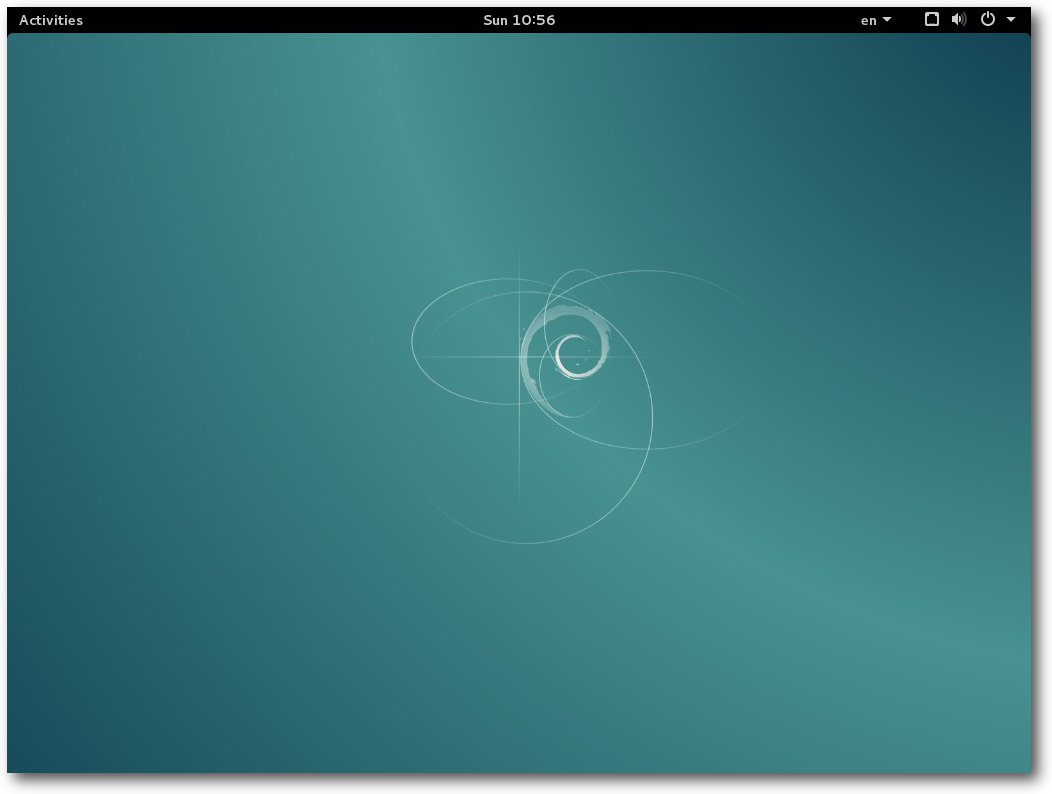

GNOME-Desktop-Design von Debian 8.

Unterstützte Systeme

Anders als viele andere Distributionen beschränkt sich Debian nicht auf die

x86-Architektur in ihren 32- und 64-Bit-Varianten. Die unterstützten

Architekturen sind jetzt, nachdem arm64 (die 64 Bit ARM-Prozessoren) und

ppc64el (64 Bit Power-Prozessoren mit Little Endian) hinzukamen und SPARC

und Itanic (pardon, Itanium) herausfielen, x86 in 32 und 64 Bit, 32 Bit

PowerPC, IBM S/390 (64 Bit), MIPS in Big- und Little-Endian-Konfigurationen,

armel und armhf für 32 Bit ARM-Systeme.

Neben den offiziellen Portierungen existieren weitere, nicht ganz

aktualisierte oder noch unvollständige Portierungen wie auch Debian/kFreeBSD

und Debian/Hurd. Damit unterstützt Debian fast alle Architekturen, auf denen

der Linux-Kernel laufen kann. Prinzipiell bietet Debian Platz für jede

Architektur, wenn sich Freiwillige dafür finden. Die

Portierungen-Seite [2] listet sie alle auf.

Neu in Debian 8

Eine der größten Neuerungen [3]

in Debian 8 ist systemd, das als stark modernisiertes Init-System viele neue

Möglichkeiten bietet. Es kann Dienste in eigenen Kontrollgruppen (cgroups)

verwalten, Dienste teilweise isolieren und kürzere Systemstartzeiten

erreichen. Das bekannte SysVinit sowie andere alternative Init-Systeme sind

weiter verfügbar.

Die in Debian 7 (siehe freiesMagazin

07/2013 [4]) vor knapp zwei

Jahren eingeführte UEFI-Unterstützung wurde laut der Ankündigung ebenfalls

stark überarbeitet. Dazu gehören Anpassungen an bekannte Firmware-Fehler,

UEFI-Unterstützung auf 32-Bit-Systemen und Unterstützung für 64-Bit-Kernel

mit 32-Bit-UEFI-Firmware (nur auf den

amd64/i386-Multiarch-Installationsmedien).

Die Distribution enthält jetzt über 43.000 Pakete, die aus knapp 20.100

Quellpaketen erstellt wurden. Der Standard-Desktop von Debian 8.0 ist GNOME

3.14. Zahlreiche weitere Desktopumgebungen und Window-Manager stehen zur

Verfügung, darunter KDE 4.14.2, Xfce 4.10 und LXDE. Eine Auswahl der

angebotenen Pakete ist Apache 2.4.10, Asterisk 11.13.1, GIMP 2.8.14, GNU

Compiler Collection 4.9.2, Icedove 31.6 (eine abgewandelte Version von

Mozilla Thunderbird), Iceweasel 31.6 (eine abgewandelte Version von Mozilla

Firefox), LibreOffice 4.3.3, MySQL 5.5.42 oder alternativ MariaDB 10.0.16,

Nagios 3.5.1, OpenJDK 7u75, Perl 5.20.2, PHP 5.6.7, PostgreSQL 9.4.1, Python

2.7.9 und 3.4.2, Samba 4.1.17, Tomcat 7.0.56 und 8.0.14, Xen 4.4.1 und X.Org

7.7.

Auch im Multimedia-Bereich zeichnet sich Debian 8 durch zahlreiche

Neuerungen aus. Die wohl wichtigste Multimedia-Bibliothek ist der

FFmpeg-Fork libav in Version 11, die das Abspielen von HECV, einen

Opus-Dekoder, Matroska 3D, Apple ProRes und einiges mehr bringt. Die neue

libebur128 ist eine freie Implementation der Lautstärken-Empfehlung der

European Broadcasting Union (EBU R128), die eine Alternative zu ReplayGain

darstellt. Sie ermöglicht es, Audio zu analysieren und beim Abspielen die

Lautstärke zu normalisieren. Weitere neue Bibliotheken sind libltc, fftease,

lyonpotpourrie, iemlib, pdstring und pd-lua.

Die Version 1.10.0 der LV2-Technologie (Linux Audio-Plugins) steht gemeinsam

mit Entwicklungswerkzeugen wie LV2 Toolkit und Vee One Suite und

Audio-Plugin-Sammlungen wie x42, zam, ste, Fomp, ab2gate, calf, eq10q,

frei0r und Naspro zur Verfügung. Mplayer wurde durch Mplayer2 ersetzt. Viele

neue Pakete kamen hinzu und zahlreiche weitere Pakete wurden aktualisiert.

Die Java-Umgebung von Debian ist weiterhin OpenJDK 7. Java-Entwickler werden

hier schmerzlich OpenJDK 8 vermissen, eine recht unverständliche Auslassung.

Zwar wird OpenJDK 8 laut den Anmerkungen über jessie-backports verfügbar

sein, vorerst muss man es aber manuell von den Oracle-Webseiten

herunterladen, wenn man es benötigt.

Der Kernel beruht in den Linux-Varianten von Debian 8 auf Linux 3.16.7. Wo

es für die Unterstützung neuer Hardware nötig ist, wurden allerdings Treiber

aus neueren Kernel-Versionen zurückportiert. Weitere Einzelheiten enthalten

die umfangreichen Anmerkungen zur

Veröffentlichung [5].

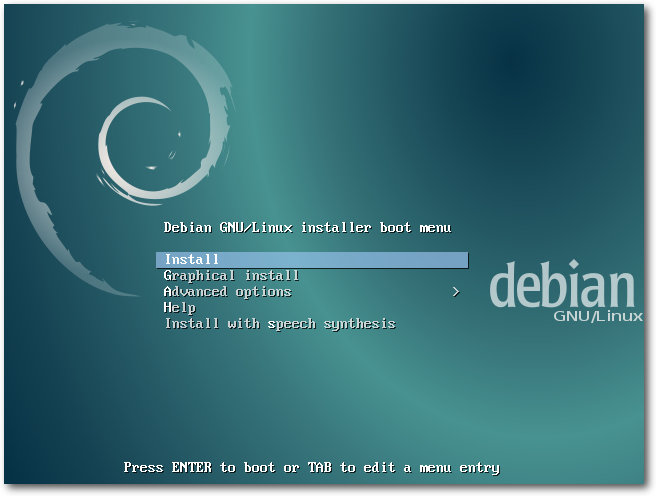

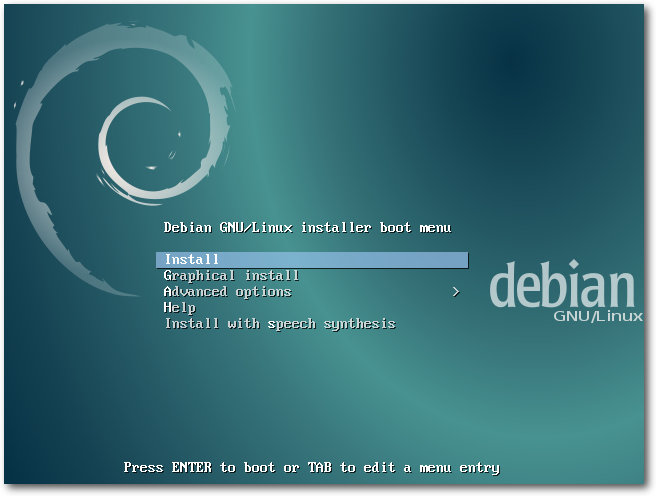

Installation

Die Installation hat sich gegenüber Debian 7 nur wenig verändert. Neuer

Kernel mit noch mehr Hardware-Unterstützung und verbesserte Unterstützung

von UEFI sind einige der wesentlichen Änderungen. Der Installer bietet schon

beim Booten viele Optionen, zum Beispiel eine textbasierte und eine

grafische Installation, normale oder Experteninstallation, automatische

Installation, Installation einer spezifischen Desktopumgebung und noch mehr.

Die Standard-Desktop-Umgebung ist GNOME. Will man eine andere Umgebung, so

kann man schon im Bootmenü des Installers unter

„Alternative Desktop Environments“ KDE, Xfce oder LXDE auswählen. Und wenn

einem das alles nicht passt, macht man eine Minimalinstallation und

erweitert diese später.

Startbildschirm des Installationsimages.

Es stehen umfangreiche

Installationshandbücher [6]

auf der Debian-Webseite zur Verfügung, für jede Architektur ein eigenes und

jeweils in mehrere Sprachen übersetzt. Besucher der Webseite bekommen das

Dokument automatisch in ihrer Sprache zu sehen, wenn ihr Browser korrekt

eingestellt und die Sprache verfügbar ist. Man muss dieses Handbuch nicht

komplett durchlesen, als Referenz kann man in Zweifelsfällen aber immer

darauf zurückgreifen.

Die empfohlene minimale RAM-Größe ist doppelt so hoch wie noch bei Debian 7.

Empfohlen werden mindestens 1 GB für ein Desktopsystem, 512 MB für andere.

Als Minimum gelten 256 MB für ein Desktop-System und 128 MB für ein

Konsolen/Server-System. Unter Umständen kann man mit noch weniger RAM

auskommen, dafür gibt es eigens einen Low-Mem-Modus des Installers. Ein

Großteil der Hardware wird automatisch erkannt und Hardware-spezifische

Pakete werden automatisch installiert. Neben der aktuellen Version von

Debian kann man auch ältere wie Wheezy installieren.

Wenn man während der Installation eine gute Netzwerkanbindung besitzt, ist

das Netzwerk-Installationsimage (ca. 250 MB) eine gute Option. Nachdem das

Installationsprogramm gestartet ist, wählt man zunächst die Sprache aus. Es

werden nun 75 Sprachen unterstützt, eine mehr als in der Vorversion. Dann

wählt man den Standort (und die Zeitzone, falls das gewählte Land mehr als

eine Zeitzone hat), darauf die Tastatur. Leider wird an dieser Stelle nur

eine Standard-Tastaturbelegung angeboten, eine verfeinerte Auswahl kann man

erst nach der Installation vornehmen, wozu man entweder das Kommando

dpkg-reconfigure keyboard-configuration oder die grafischen Werkzeuge der

Desktopumgebungen nutzen kann.

Nach dem Nachladen verschiedener Komponenten, das ein wenig dauern kann,

will das System den Rechnernamen wissen, dann den Domainnamen. Findet das

System bereits über DHCP diese Informationen heraus, dann entfallen diese

beiden Schritte. Bevor DHCP möglich ist, kann es jedoch erforderlich sein,

Firmware in die Netzwerk-Hardware zu laden. Freie Firmware bringt Debian

bereits mit, doch es gibt auch Hardware, die unfreie Firmware benötigt. Da

Debian diese nicht mehr mitliefert (außer auf den non-free-Images), ist es

in solchen Fällen erforderlich, diese nachzuladen.

Alles Nötige hierfür hat der Installer bereits vorgesehen. Ob WLAN- oder

normale LAN-Chips, USB-Geräte oder spezielle Festplattencontroller – wenn der

Installer eine benötigte Firmware nicht vorfindet, sucht er selbständig auf

Disketten oder USB-Sticks danach. Wie man ein passendes Medium vorbereitet,

ist im Installationshandbuch beschrieben. Oft ist die Firmware als separates

Paket in der Non-Free-Sektion des Archivs verfügbar, nur in wenigen Fällen

dürfte es nötig sein, die Download-Seiten des Herstellers abzugrasen. Nur

muss man dies tun, bevor man die Installation beginnt.

Nach der Komplettierung der Netzwerkeinrichtung ist ein Root-Passwort

einzugeben, wobei Debian auch schwache Passwörter akzeptiert. Das Passwort

kann auch leer gelassen werden, was zu einer Ubuntu-ähnlichen Einrichtung

führt, bei der man nur mit sudo zum Root-Account wechseln kann.

Darauf kann man einen separaten Benutzer anlegen. In aufeinanderfolgenden

Dialogen werden der vollständige Name, der Name des Benutzerkontos und das

Passwort abgefragt. Man hätte an verschiedenen Stellen mehrere dieser

Dialoge zusammenlegen und die Installation damit etwas straffen können.

Leider hat sich diesbezüglich gegenüber Debian 7 nichts getan, andererseits

ist es kein wesentlicher Zeitverlust. Eine Installation von Ubuntu,

openSUSE, Mandriva oder Fedora mag eleganter wirken, in Sachen Features und

Flexibilität dürfte Debian aber kaum zu übertreffen sein.

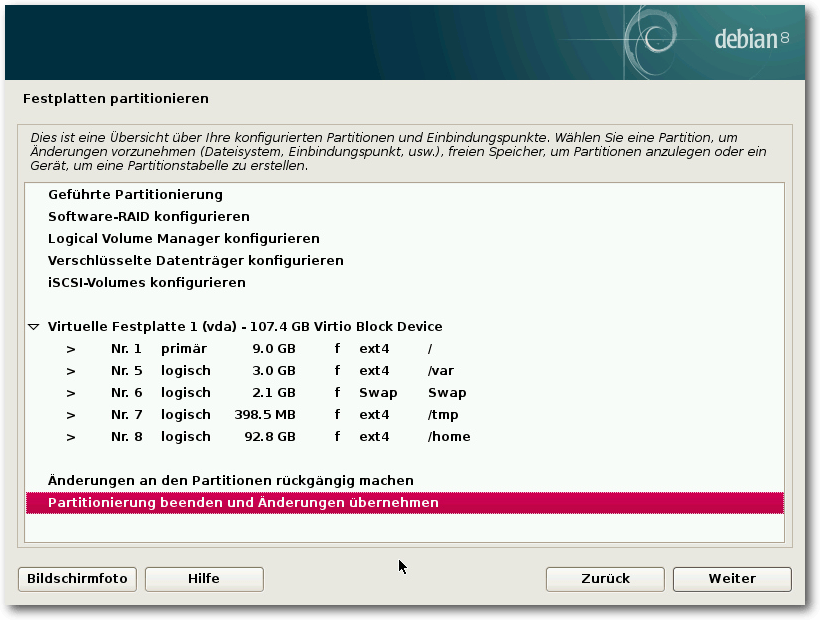

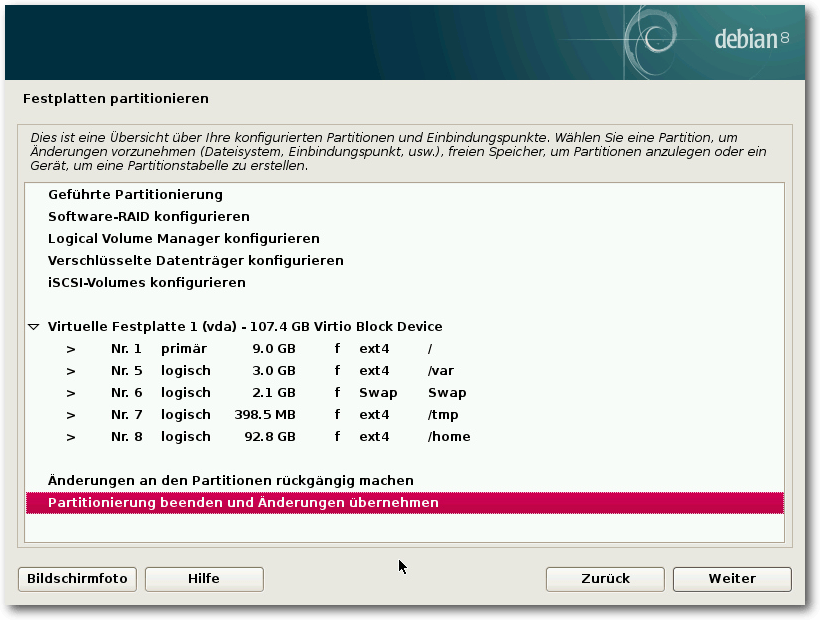

Nun kommt man zur Partitionierung, einem Punkt, der mit fünf Klicks auf

„Weiter“ und einer Bestätigung erledigt werden, aber auch längere Zeit in

Anspruch nehmen kann, wenn man sein System für eine langfristige und/oder

komplexe Nutzung auslegt. Für letzteres wählt man „Manuelle

Partitionierung“. Nun kann man völlig frei partitionieren, LVM,

Software-RAID (einschließlich Fake-RAID), Verschlüsselung und Multipath in

beliebigen Kombinationen einsetzen und die Dateisysteme und Mount-Punkte

zuweisen. Alles lässt sich wieder rückgängig machen, außer der Einrichtung

von LVM, die vor der weiteren Arbeit auf die Platte gespeichert werden muss.

Dabei schließt das Programm unmögliche oder problematische Konfigurationen

aus bzw. warnt vor diesen. Angebotene Dateisysteme sind ext2, ext3, ext4

(Standard), Btrfs, jfs, xfs, FAT16, FAT32, sowie qnx4 und NTFS (nur lesend).

Nach der Partitionierung und Formatierung folgt die Installation des

Basissystems, während derer man sich anderen Dingen widmen kann. Danach kann

man weitere Software nach groben Kategorien auswählen. Standardmäßig sind

„Debian desktop environment“ und „Standard-Systemwerkzeuge“ aktiviert.

Falls die Pakete aus dem Internet heruntergeladen werden müssen, wird zuvor

der Paketmanager konfiguriert. Auch die folgende Installation dauert eine

Weile. Man hätte diese Auswahl vorziehen sollen, wodurch es nicht nötig

wäre, zwischendurch an den Rechner zurückzukommen. Nach dem erfolgreichen

Abschluss der Installation kann man den Bootloader installieren lassen.

Standardmäßig installiert Debian GRUB 2 im Bootsektor, doch wenn man „nein“

wählt, kann man selbst ein Gerät für die Installation auswählen. Nun ist das Ende

der Installation erreicht und man kann das neue System starten.

Partitionierung.

Update

Das Update einer bestehenden Debian-Installation ist möglich und dürfte

meist reibungslos funktionieren. Installierte Pakete aus externen

Repositorys (darunter auch debian-backports) können allerdings Probleme

bereiten. Dennoch kann man zunächst das Update normal probieren; sollten

Probleme auftreten, kann man die betroffenen Pakete entfernen und später

eventuell in einer neueren Version wieder installieren.

Ein Online-Update liefert nicht notwendigerweise dasselbe Ergebnis wie eine

Neuinstallation. Der Hauptgrund dafür sind diverse Pakete, die in der neuen

Version durch andere ersetzt wurden. Als

Beispiel könnte man PostgreSQL 9.1

nennen, das nicht automatisch auf 9.4 aktualisiert wird. Ähnlich ist es mit

Python, Ruby und anderen. Weitere Pakete listet Kapitel 4.10 der Anmerkungen

zur Veröffentlichung auf.

Natürlich wird ein Update nur von der direkten Vorgängerversion 7

unterstützt. Alle Einzelheiten zum Update sind in einem eigenen Kapitel der

Anmerkungen zur Veröffentlichung ausführlich erläutert.

Der Desktop

Debian 8.0 startet vergleichbar schnell wie andere Linux-Distributionen,

wobei keine genauen Zeiten gemessen wurden. Wie gehabt werden je nach

Desktopsystem unterschiedliche Display-Manager eingesetzt. Wurde GNOME

installiert, dann startet Debian mit dem Display-Manager gdm, für KDE ist es

kdm. Das ergibt Sinn, da diese Display-Manager für die jeweilige

Desktopumgebung optimiert sind und sich am besten in dieser integrieren. Der

Login-Bildschirm wurde in allen Fällen mit einem neuen Debian-Design

versehen. Das neue Design ist vom Bootloader bis zum Desktop durchgängig.

Suchen in der GNOME-Shell.

GNOME ist in Version 3.14 enthalten, da GNOME 3.16 erst lange nach dem

Freeze-Termin erschienen ist. Neuerungen in GNOME 3.14 sind unter anderem

verbesserte Unterstützung für Touch-Gesten und Displays hoher Auflösung, ein

überarbeiteter Dokumentenbetrachter, eine überarbeitete Wetter-App, die

Unterstützung für Google Picture in der Fotoverwaltung Photo und eine

automatische Handhabung für WiFi-Hotspots. Außerdem wurden die

mitgelieferten Programme in vielen Punkten verbessert und aktualisiert. Das

Theme Adwaita wurde vollständig neu geschrieben und bietet jetzt neue

Menüleisten, animierte Schalter, verbesserte Benachrichtigungsdialoge und

überarbeitete Spinner-Animationen. Der Gebrauch von Animationen wurde

generell verstärkt. Da GNOME jetzt EGL voraussetzt und der fglrx-Treiber das

nicht unterstützt, ist der proprietäre AMD-Treiber mit GNOME nicht nutzbar.

Besonderheiten sind in dem Desktop-System, das rund 415 MB Speicher belegt,

nicht zu entdecken. KDE hingegen, das in Version 4.14.2 enthalten ist,

benötigt etwa 435 MB. Zu den standardmäßig installierten Programmen unter

GNOME gehören LibreOffice 4.3.3, der Mail- und Kalender-Client Evolution,

GIMP 2.8.14, Inkscape 0.48.5 und Rhythmbox 3.1. Shotwell wurde durch GNOME

Fotos ersetzt, Tomboy durch GNOME Notes. Mit Tomboy konnte auch auf Mono in

der Standardinstallation verzichtet werden. Das Videokonferenzprogramm

Empathy ist in Version 3.12 vorhanden. GStreamer 0.10 und 1.4 sowie

PulseAudio 5.0 werden standardmäßig installiert.

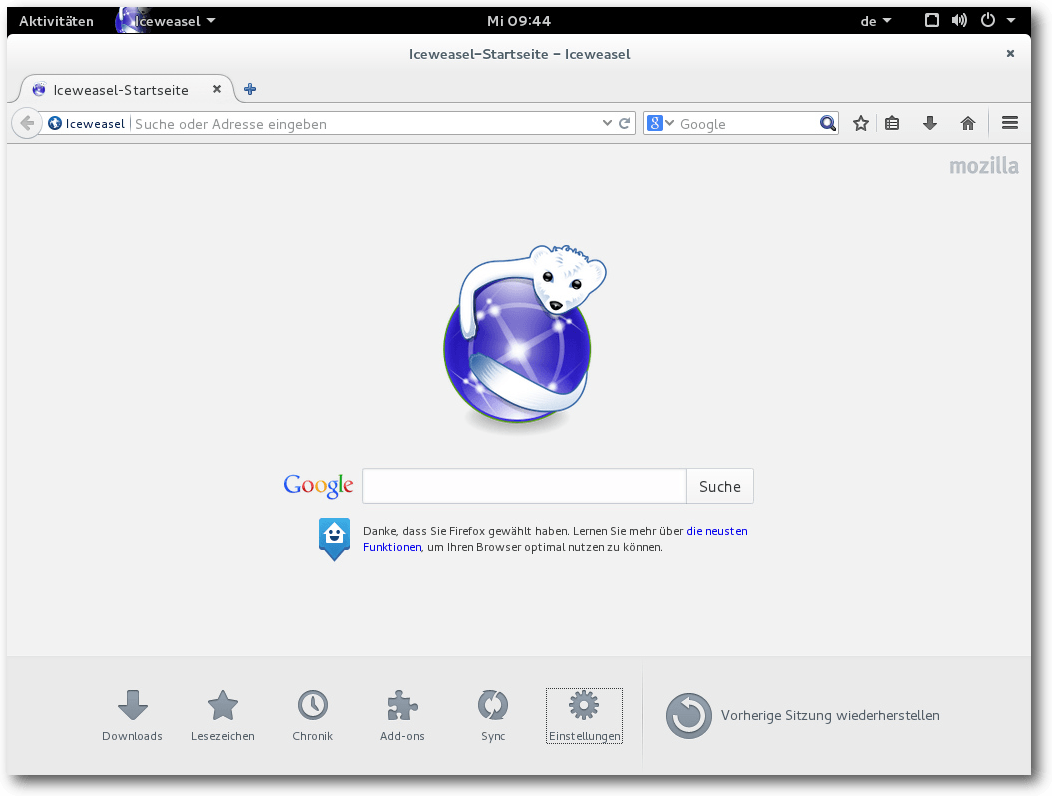

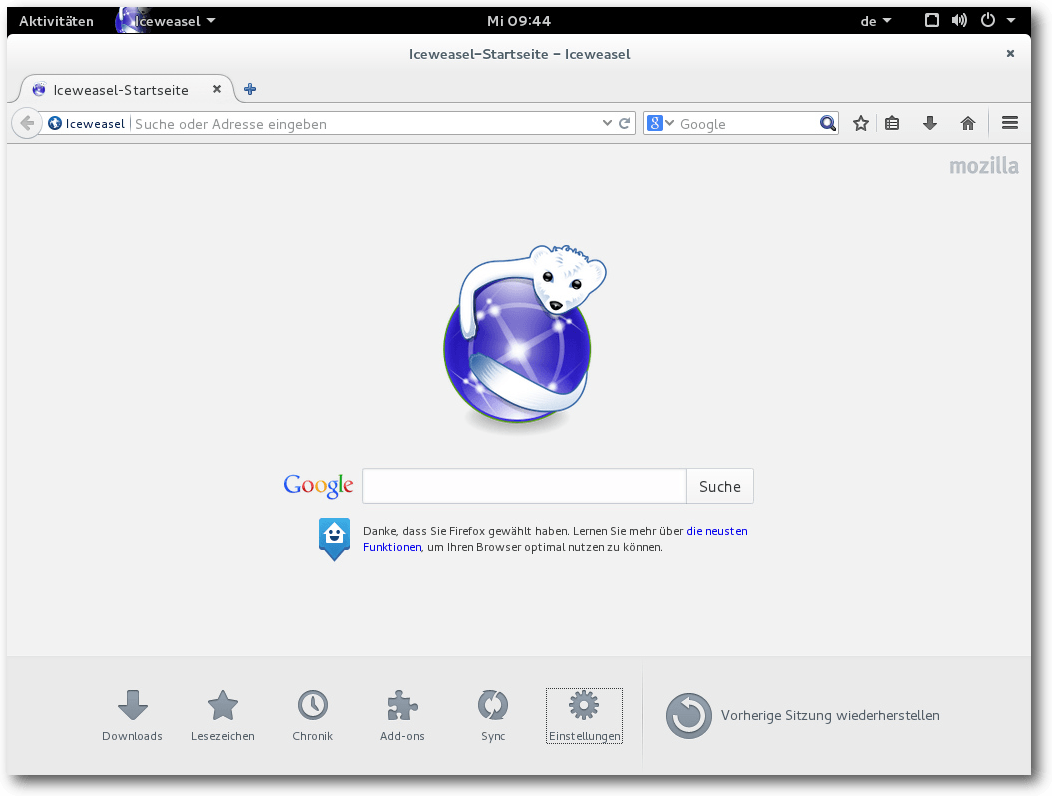

Der Standard-Browser unter GNOME ist nun Iceweasel, die Debian-Variante von

Firefox, in Version 31.6. Wichtig zu wissen ist, dass Debian nicht den

üblichen Support für alle auf Gecko oder Webkit beruhenden Browser

bereitstellt, da diese zu schnelllebig sind und es Distributionen zu schwer

gemacht wird, Sicherheitskorrekturen zurückzuportieren. Stattdessen führt

Debian regelmäßige Aktualisierungen der Browser durch und kann keine der

sonst üblichen Kompatibilitätsgarantien geben. Vorinstallierte Plug-ins von

Iceweasel sind die GNOME-Shell-Integration und ein iTunes Application

Detector. Keine Erweiterungen sind in dieser Version vorinstalliert.

Iceweasel 31 unter GNOME.

Die GNOME-Shell kann dank Software-Rendering auf jeder Hardware laufen, auch

wenn keine Hardware-3-D-Beschleunigung zur Verfügung steht. Das

Software-Rendering ist einigermaßen schnell und durchaus noch benutzbar,

doch wird man es wohl kaum ertragen, wenn man keinen sehr schnellen

Prozessor hat. Die Situation bessert sich mit einem Mehrkern-Prozessor, doch

Videos verzögerungsfrei abzuspielen, ist auf diese Weise schwer. Bei kleinen

Videoformaten kann es aber noch gelingen.

Das gnome-tweak-tool, auf Deutsch „Optimierungswerkzeug“ genannt, ist

standardmäßig installiert, denn man benötigt es, um Erweiterungen für die

GNOME-Shell zu installieren, da dafür kein Weg in der Standardkonfiguration

vorhanden ist. Daneben kann man auch andere Dinge einstellen, die die

GNOME-Entwickler nicht in der GUI konfigurierbar gemacht haben.

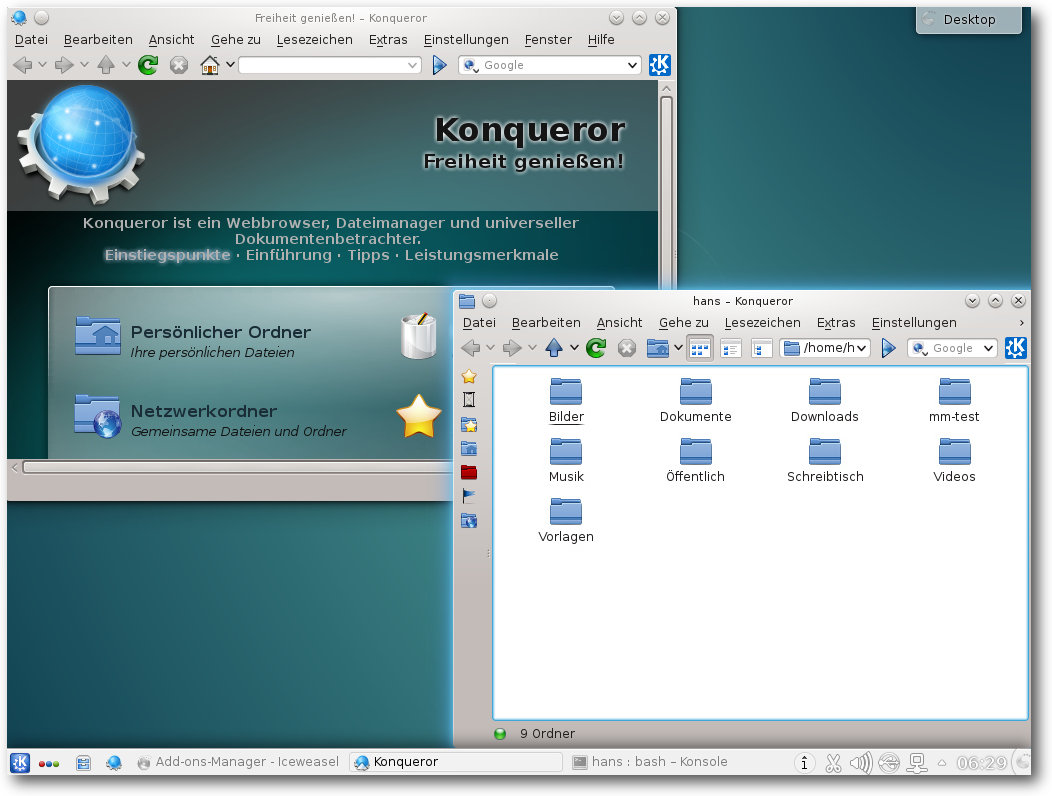

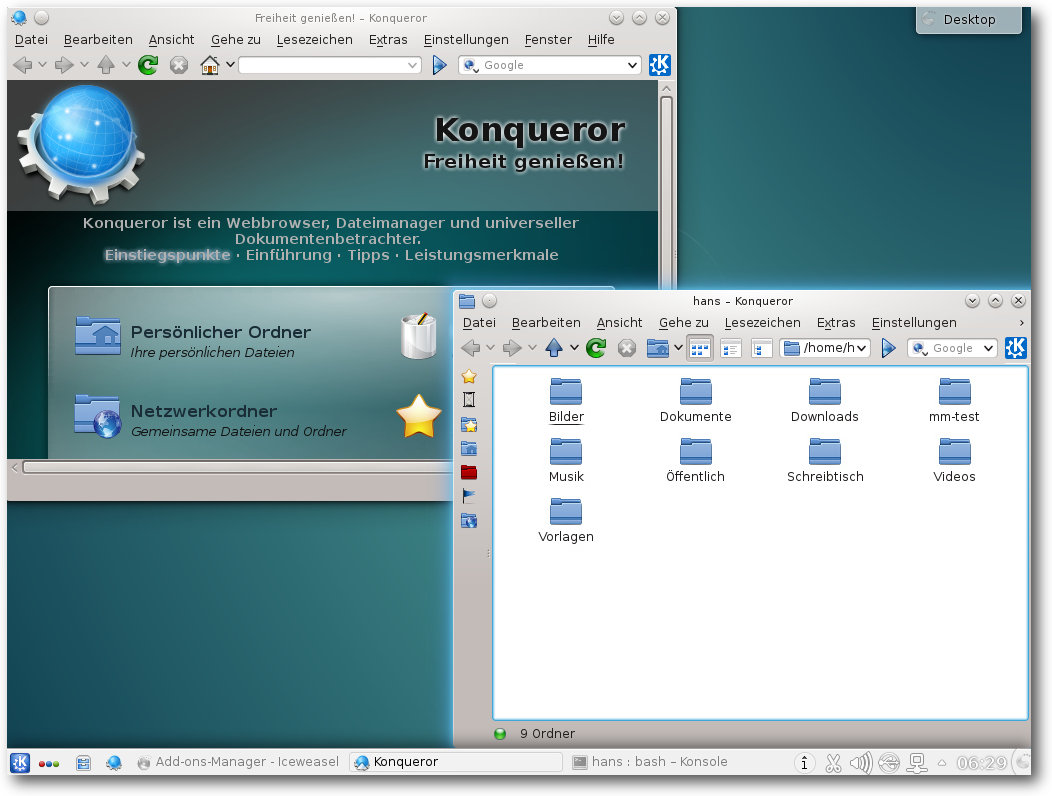

Der Standard-Browser in KDE ist immer noch Konqueror. Die doppelte Natur von

Konqueror als Webbrowser und Dateimanager tritt zutage, wenn man ihn über

die Systemleiste startet, dann zeigt er sich nämlich als Dateimanager. Im

Kickoff-Menü ist hingegen Dolphin als Dateimanager eingetragen.

Zweimal Konqueror: Webbrowser und Dateimanager.

Iceweasel ist ebenfalls installiert, die Konfiguration ist aber eine andere

als unter GNOME. An Plug-ins ist nur „Skype Buttons für Kopete“

vorinstalliert. Erweiterungen sind dagegen in der Grundausstattung keine

vorhanden. Neben der KDE-PIM-Suite 4.14.2 sind auch LibreOffice und GIMP

vorhanden, darüber hinaus außer den zu KDE gehörenden Programmen nur wenig.

Als Anwendung zum Abspielen von Medien ist VLC 2.2.0-rc2 installiert.

Gegenüber dem in Debian 7 enthaltenen KDE 4.8 hat sich natürlich einiges

getan, obwohl die Plattform weitgehend seit Version 4.9 und der Desktop seit

4.11 eingefroren sind. Zu nennen sind unter anderem die neue semantische

Suche

Baloo (seit 4.13), die weitgehende Umstellung der Plasma-Oberfläche

auf Qt Quick, was hauptsächlich interne Änderungen bedeutete, aber den

Benutzern auch verbesserte Widgets bringt, Optimierungen im Window-Manager

KWin, Farbkorrektur mit Farbprofilen, ein Druckmanager und verstärkte

Integration der Aktivitäten. Die hauptsächlichen Änderungen sind jedoch in

den einzelnen Anwendungen und der PIM-Suite zu finden, die zahllose Erweiterungen und

Verbesserungen erhalten haben.

Debian installiert die Schriften DejaVu, die eine recht große

Unicode-Abdeckung besitzt, Liberation von Red Hat, FreeFont und diverse

andere. Viele weitere sind im Archiv zu finden. Dabei gab es keine größeren

Änderungen gegenüber Debian 7.

Abseits des Desktops bietet Debian eine sehr große Zahl von Tools, stellt

sich aber auch der manuellen Änderung der Konfigurationsdateien nicht in den

Weg. Debian hat teils recht aufwendige Konstrukte entwickelt, um die vom

System vorgegebene und die von den Nutzern geänderte Konfiguration zu

trennen und die Verwaltung so einfach wie möglich zu machen. Oft muss man

erst die README-Datei lesen, um sich mit dem Debian-System vertraut zu

machen. Es lohnt sich fast immer, eigene Änderungen an die Debian-Vorgaben

anzupassen, da man sonst alles selbst machen muss, Sicherheitsupdates

eingeschlossen.

Jedes Tool und jede Konfigurationsdatei ist in einer Manpage dokumentiert,

was von den Debian-Richtlinien vorgeschrieben ist. Diese Dokumentation

vermisst man bei vielen anderen Distribution schmerzlich. Für die

Debian-Entwickler gehören Manpages zu den Dingen, die die Qualität einer

Distribution ausmachen.

Multimedia

Es mag viele Benutzer überraschen, obwohl es schon in der Vorversion so war,

dass Debian Codecs für alle populären Multimediaformate mitliefert und somit

ohne jede Umstände, die man in manch anderen Distributionen hat, über

vollständige Multimedia-Unterstützung verfügt. Es dürfte bekannt sein, dass

das einzige Problem dieser Codecs ist, dass sie von Softwarepatenten

betroffen sind. Dies gilt hauptsächlich für die USA und Japan, in geringerem

Maße für die EU. Debian fürchtet jedoch nicht, jemals verklagt zu werden.

Anwender von Debian, die hohe Gewinne erwirtschaften, sollten jedoch

genau prüfen, inwieweit sie vom Open Invention

Network oder anderen Initiativen vor Patentklagen geschützt sind, denn

Debian selbst kann keinen Schutz bieten.

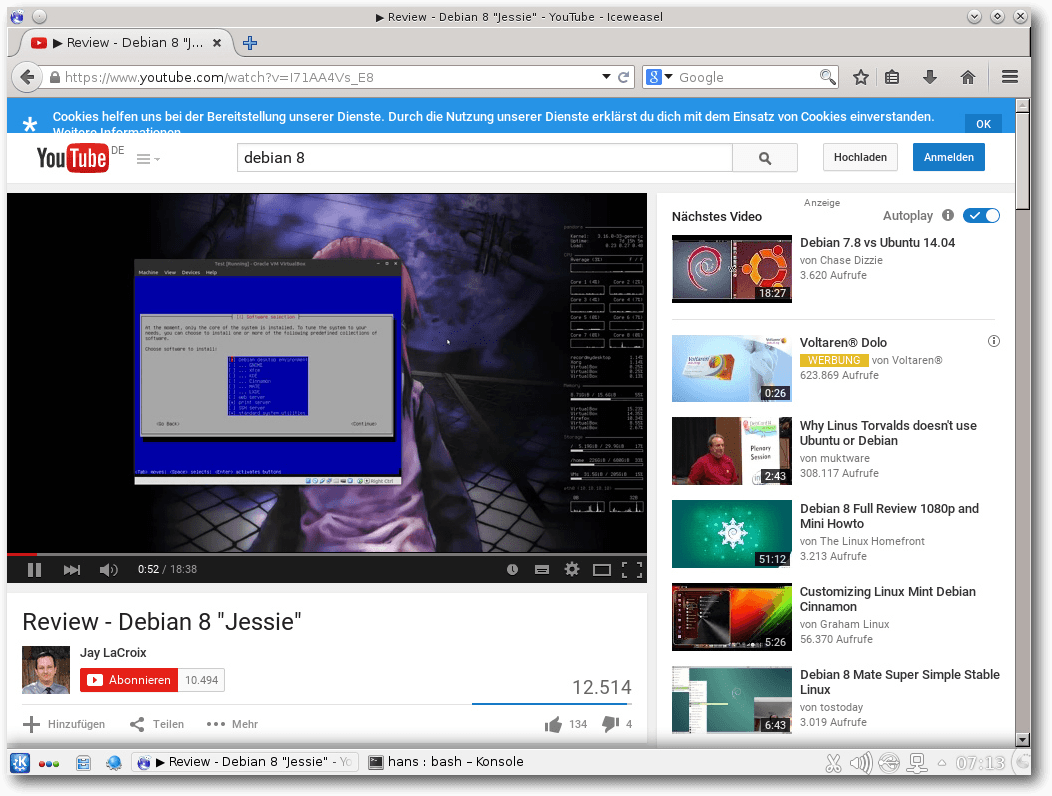

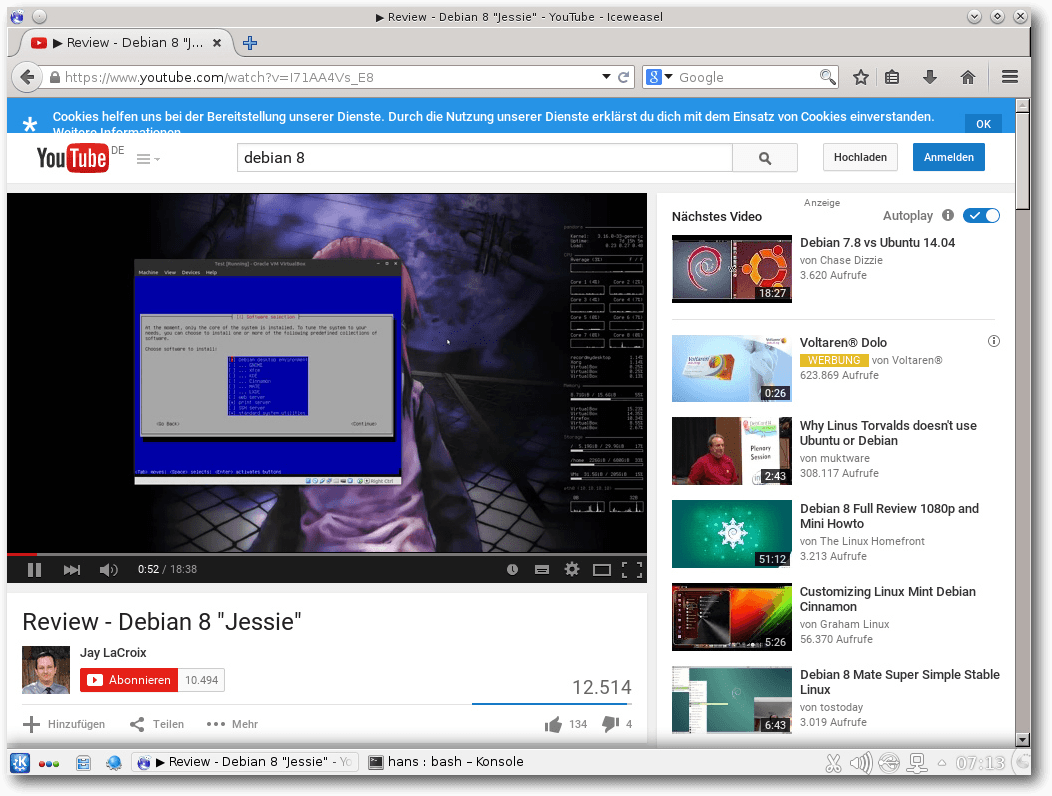

Somit laufen unter Debian MP3 und alle Videoformate ohne Zutun, auch

Flash-Videos. Ein schwierigerer Punkt sind jedoch Flash-Videos auf

Webseiten. Einige Seiten versagen ohne Nachrüstung des Adobe Flash Players

komplett ihren Dienst. Den Player gibt es für Firefox bzw. Iceweasel zwar

noch, er wird aber bis auf Korrekturen von Sicherheitslücken nicht mehr

gepflegt. Das größte Problem ist jedoch, dass Mozilla den Benutzern viele

lästige Hürden in den Weg legt, wenn sie das Plug-in weiter in Firefox

nutzen wollen. Workarounds sind die Verwendung eines anderen proprietären

Browsers wie Google Chrome oder Chromium mit dem von Google stammenden

proprietären

Pepperflash-Plug-in [7].

Keine Probleme mit YouTube-Videos, aber für Flash-basierte Seiten ist ein Firefox-basierter Browser nicht brauchbar.

Das Debian-Multimedia-Projekt

deb-multimedia.org [8] ist in vielen Fällen

nicht mehr nötig. Eine Ausnahme ist das Abspielen von verschlüsselten DVDs.

Die benötigte Bibliothek libdvdcss2 kann Debian nicht mitliefern, man

findet sie aber beim Debian-Multimedia-Projekt oder auf

der VideoLAN-Seite [9]. Debian untersucht

zur Zeit, ob diese Bibliothek nicht doch offiziell mitgeliefert werden kann.

Unter KDE wird zum Abspielen von Audio – jedenfalls MP3 – nicht Amarok als

Standard-Player verwendet, sondern VLC. Videos werden mit Dragonplayer

abgespielt. Dragonplayer ist, anders als unter Ubuntu und Fedora in der

Lage, Videos korrekt abzuspielen. Möglicherweise ist Phonon unter Debian auf

ein anderes Backend eingestellt als in Ubuntu und Fedora.

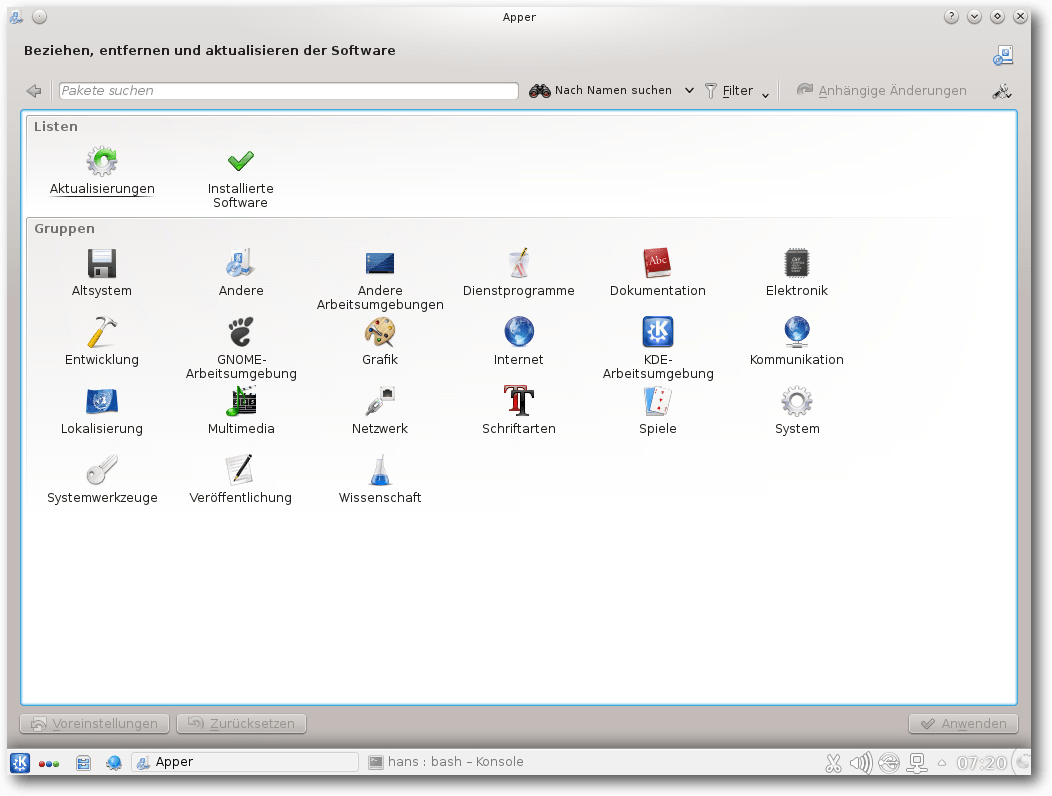

Paketverwaltung

Debian setzt auf PackageKit, das mit der eigenen Paketverwaltung Apt

zusammenarbeitet. Unter GNOME und KDE wird mindestens einmal pro Woche

automatisch geprüft, ob Software-Updates vorliegen, und das Vorhandensein

von Updates angezeigt. Für die grafische Paketverwaltung steht

gpk-application bereit, für die Aktualisierungen der zugehörige

gpk-update-viewer. GNOME-Software, das App-Store-ähnliche Programm von

GNOME, ist nicht installiert, dafür aber das gute alte Synaptic, das keine

Wünsche offenlässt, in Version 0.81.2.

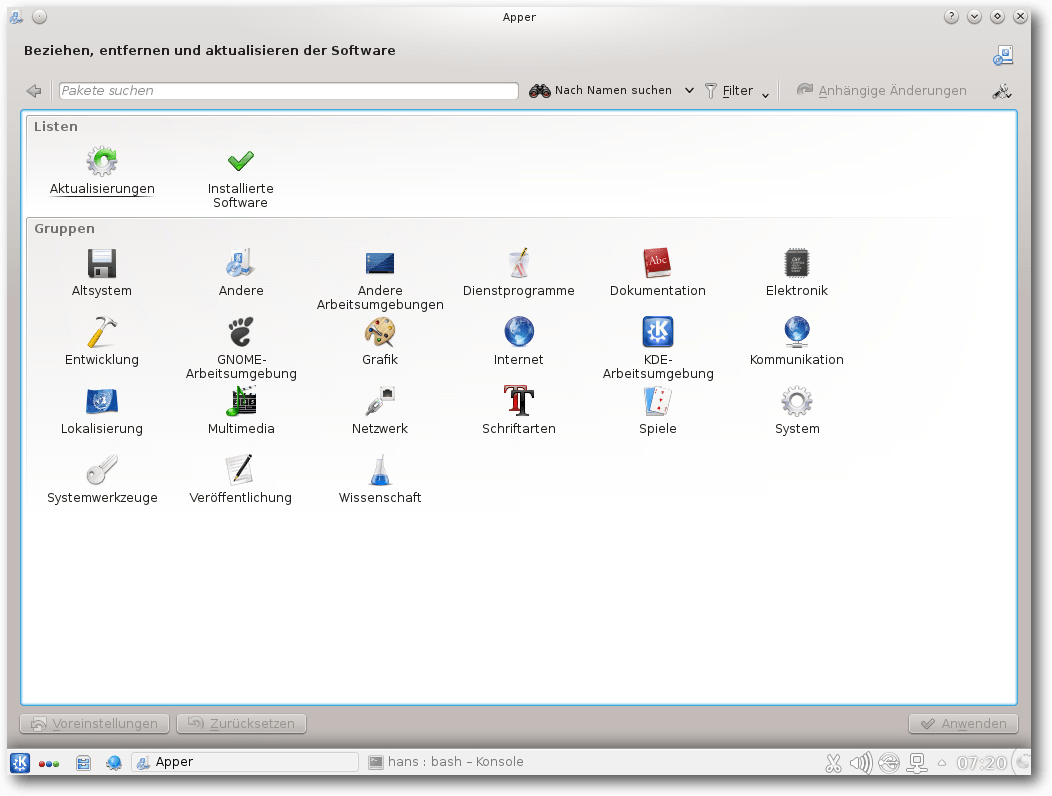

Unter KDE wird Apper, der Nachfolger von KPackageKit, jetzt in Version 0.9.1

genutzt. Dieses Programm wurde auch von Kubuntu eingesetzt, bis es dort

durch die Neuentwicklung Muon ersetzt wurde.

Übersichtsseite von Apper.

Debians Paket-Updates sind erfahrungsgemäß durch das Ausbleiben von

Überraschungen gekennzeichnet. Neue Programmversionen bringt Debian während

des Lebenszyklus der Distribution normalerweise nicht. Es werden lediglich

Sicherheitslücken und kritische Fehler korrigiert. Ausnahmen sind lediglich

Programme, die von den Originalprojekten nur mangelhaft gepflegt werden, vor

allem Firefox.

Kleinere Fehler in Anwendungen werden von Debian grundsätzlich nicht mehr

korrigiert, wenn die Distribution veröffentlicht ist. Die Benutzer müssen

selbst entscheiden, wie sie darauf reagieren. Schwerwiegende Fehler

werden nach Möglichkeit im Rahmen der kleinen Distributions-Updates behoben,

die alle paar Monate stattfinden. Geplant ist bereits die Herausgabe von

Debian 8.1, alles weitere wird sich ergeben.

Die meisten Benutzer können mit dem stabilen Distributionszweig auskommen,

in den man in Einzelfällen bei Bedarf Aktualisierungen einbaut, vorzugsweise

über backports.debian.org, notfalls auch über Debian Testing oder Unstable.

Dies minimiert den Wartungsaufwand.

Andere Möglichkeiten sind das Einbinden

von externen Repositorys, das Importieren von RPM-Paketen mit alien, das

Kompilieren von Hand und das Bauen von eigenen Paketen. Dies ist sicher

keine vollständige Aufzählung. Wer Software von Hand kompiliert, wird das

Programm checkinstall wahrscheinlich nützlich finden, das die Software

als minimales Debian-Paket installiert.

Fazit

In den zwei Jahren der Entwicklung erhielt Debian 8 zahlreiche

Aktualisierungen, aber im Grunde nur eine echte Umwälzung, nämlich systemd.

Im Nachhinein ist es verwunderlich, wenn nicht grotesk, wie eine so große

Diskussion um das neue Init-System entstehen konnte. systemd betrifft

Basisfunktionen des Systems, von denen die meisten Benutzer kaum je etwas

mitbekommen. Administratoren müssen allerdings einige neue Befehle lernen.

Auf der anderen Seite haben sich viele Programme in den letzten zwei Jahren

kaum geändert oder wurden einfach stetig erweitert. So sind die Unterschiede

zwischen Debian 8 und dem Vorgänger im Prinzip nicht sehr groß. Dies scheint

aber ein Trend zu sein, der bei allen Distributionen in den letzten Jahren

zu beobachten ist. Vielleicht ist es aber aber auch so, dass die Neuerungen

in immer mehr Bestandteilen der Distributionen nicht mehr zu zählen sind und

man daher sozusagen einen Schritt zurücktritt, um einen besseren Überblick

zu erhalten. Dann kommen einem die Änderungen aber zwangsläufig kleiner vor.

Debian bleibt weiter das „universelle Betriebssystem“, als das es sich

sieht, und übertrifft alle andere Distributionen in einem oder mehreren der

folgenden Punkte: Zahl der unterstützten Architekturen, Einsetzbarkeit in

den verschiedensten Bereichen (Desktop, Laptop, Server, Cloud-Server, Smartphones, NAS-Geräte, etc.),

Flexibilität der Installation, Lieferumfang und

Dokumentation.

Nicht zu vergessen sind die zahlreichen von Debian abgeleiteten

Distributionen, die zum Teil mehr Nutzung erfahren als Debian selbst. Für

alle diese ist Debian unverzichtbar.

Links

[1] http://www.pro-linux.de/artikel/2/1771/debian-gnulinux-80-jessie.html

[2] http://www.debian.org/ports/

[3] https://www.debian.org/News/2015/20150426

[4] http://www.freiesmagazin.de/freiesMagazin-2013-07

[5] http://www.debian.org/releases/jessie/releasenotes

[6] http://www.debian.org/releases/stable/installmanual

[7] https://wiki.debian.org/PepperFlashPlayer

[8] http://www.deb-multimedia.org/

[9] http://download.videolan.org/debian/

| Autoreninformation |

| Hans-Joachim Baader (Webseite)

befasst sich bereits seit 1993 mit Linux. 1994 schloss er

erfolgreich sein Informatikstudium ab, machte die

Softwareentwicklung zum Beruf und ist einer der Betreiber von

Pro-Linux.de.

|

Beitrag teilen Beitrag kommentieren

Zum Inhaltsverzeichnis

von Gerrit Kruse

In der Diskussion zur Ankündigung eines neuen Release der Community Enterprise

Distribution CentOS fragt ein Benutzer, welche Distribution die bessere Wahl für

den Desktop wäre: CentOS oder Debian. Die Antwort in einem Beitrag lautet:

Arch-Linux. So nachzulesen bei Heise Online. Das Ergebnis dieses netten Dialogs

ist weniger, dass Arch-Linux sich wirklich gut als Langzeitdistribution eignet,

sondern vielmehr, dass die unterschiedlichen Distributionsmodelle sich in den

letzten Jahren weit voneinander entfernt haben.

Redaktioneller Hinweis: Der Artikel „Linux-Distributionen mit Langzeitunterstützung“ erschien

erstmals im Blog von [Mer]Curius [1].

So weit, dass Nutzer des einen Modells die Anforderungen der Benutzer des

anderen Modells kaum noch nachvollziehen können. Waren vor wenigen Jahren noch

stabile Veröffentlichungen alle paar Monate üblich, gibt es heute Distributionen

mit Laufzeiten von 10 Jahren auf der eine Seite und das Rolling Release-Modell ohne

offizielle Installationsroutine auf der anderen.

Während im Serverbereich Distributionen mit einer Supportdauer von mehreren

Jahren weit verbreitet sind und eine hohe Akzeptanz genießen, wurden solche

Distributionen für den Desktop lange Zeit nicht empfohlen. Zu alt sei die

Hardwareunterstützung, zu veraltet Desktopumgebung und Programme. Diese

Einstellung hat sich in den letzten Jahren deutlich verändert.

Im Wesentlichen gibt es zur Zeit drei Release-Modelle für Distributionen:

- Der „klassische“ Release: Ein neuer Release erfolgt alle paar Monate (6-12), die Distribution wird für einen bestimmten – in Monaten gemessenen – Zeitraum unterstützt.

- Der Langzeitsupport (LTS) Release: Ein neuer Release erfolgt alle paar Jahre, die Distribution wird für einen bestimmten – in Jahren gemessenen – Zeitraum unterstützt.

- Das Rolling Release Modell: Kernel, Bibliotheken und Programme werden laufend aktualisiert. Gegebenenfalls werden Snapshots zur Installation zur Verfügung gestellt.

Anhänger des letzteren Distributionsmodells sind der Ansicht, dass ihnen diese

Form langfristig weniger Arbeit bereitet. Größere Distributionsupgrades bleiben

schließlich auf diese Weise aus. Der Ansatz vieler einfacher (und

fortgeschrittener) Nutzer, dass jedes Update nervig ist und keine neue Version

für diesen Aufwand mit äquivalenten Funktionen entschädigt, können sie nicht

nachvollziehen. Die Tendenz in der Linuxwelt geht dennoch in die andere

Richtung. Distributionen mit sehr langen Laufzeiten gibt es immer mehr und ihre

Bedeutung – gemessen an der Nutzerzahl und medialer Aufmerksamkeit – steigt an.

Im Folgenden sollen deshalb einige präsentiert werden.

Langzeit-Distribution

Der Begriff Langzeitdistribution ist nicht genau definiert. In der Regel werden

darunter Distributionen mit einem Supportzeitraum von mehreren Jahren

verstanden. Während openSUSE mit 18 Monaten Support herkömmlicherweise nicht als

Langzeitdistribution gesehen wird, ist Debian mit ca. 3 Jahren Unterstützung

klassischerweise unter den Langzeitdistribution eingeordnet. Das

Auswahlkriterium dieses Beitrags sind deshalb 3 Jahre Unterstützung oder länger.

Debian

Debian [2] ist vielleicht „die“ Long-Term-Support

Distribution schlechthin. Abgesehen vom Unstable- und Testingzweig gibt es keine

anderen Veröffentlichungen des Debian Projekts. Debian veröffentlicht nach

keinem festen Zeitplan, bringt aber in der Regel alle zwei Jahre eine neue

Version heraus. Diese wird bis zum Erscheinen der nächsten Version unterstützt,

plus weitere 12 Monate. Im vergangenen Jahr wurde zudem eine Verlängerung der

Supportperiode eingeführt. Diese testweise für Debian 6.0 Squeeze eingerichtete

LTS-Version wird durch interessierte Firmen finanziert und beschränkt sich auf

einen limitierten Paketumfang. Sofern das Projekt erfolgreich ist werden

LTS-Versionen für Debian 7.0 und 8.0 folgen.

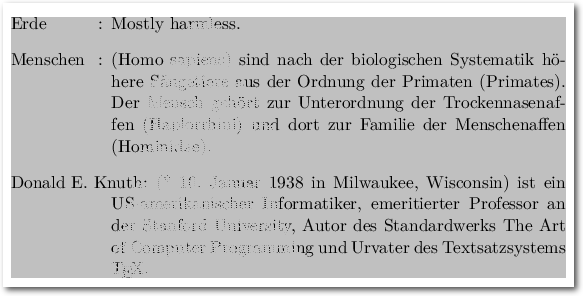

Debian Jesse mit GNOME. © Debian Project (GNU General Public License 3)

Vorteile von Debian:

- Der Support erstreckt sich auf alle in den Paketen verfügbaren Programme.

- Die Paketquellen decken fast das ganze Repertoire der freien Software ab.

- Die Richtlinien sind sehr strikt. Es werden keine neuen Versionen in eine stabile Version eingepflegt.

- In regelmäßigen Abständen werden neue Installationsmedien als Unterversionen (z. B. 7.x

für Wheezy) herausgegeben. Bei Neuinstallationen werden dadurch viele Aktualisierungen erspart.

- Über die offizielle Backportquelle lassen sich für viele Programme aktuellere Versionen einspielen. Diese entstammen dem aktuellen Testingzweig.

- Distributionsupgrades zwischen den Versionen sind möglich.

Nachteile von Debian:

- Der Supportzeitraum mit lediglich ca. 3 Jahren Support ist verhältnismäßig gering.

- Neue Versionen erscheinen regelmäßig, sind aber nicht exakt planbar.

- Gegen Ende des Supportzeitraumes kann die Unterstützung für einzelne Pakete eingestellt werden. Dies wird jedoch nicht klar kommuniziert.

Es gibt auch eine große deutschsprachige Community [3]

für Debian.

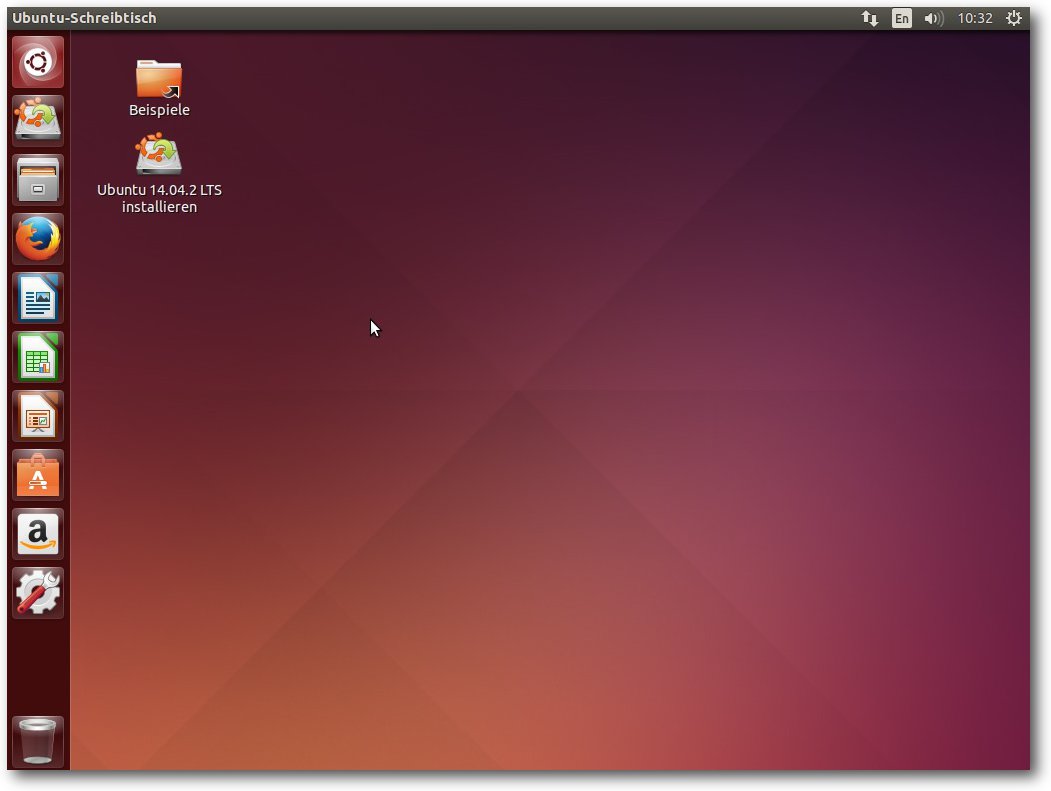

Ubuntu und die offiziellen Derivate

Ubuntu [4] ist die möglicherweise am weitesten

verbreitete Linux-Distribution und den meisten ein Begriff. Die Entscheidung,

LTS-Versionen einzuführen, traf man bereits sehr früh in der

Entwicklungsgeschichte von Ubuntu mit dem Release von Dapper Drake im Jahr 2006.

Ursprünglich galt der Support für den Desktop nur drei Jahre, während die

Serverpakete 5 Jahre unterstützt wurden. Diese Trennung wurde mit dem Release

von 12.04 aufgehoben, seitdem werden

Desktop- und Serverversion 5 Jahre

unterstützt. Die Community-Derivate Kubuntu, Xubuntu, Lubuntu, Ubuntu GNOME und

Ubuntu MATE bringen jeweils eigene LTS-Versionen heraus. Diese haben allerdings

nur eine kürzere Laufzeit von 3 Jahren, mit Ausnahme von Kubuntu, das ebenfalls 5 Jahre

unterstützt wird. Alle zwei Jahre erscheint im April eine neue LTS Version,

dazwischen veröffentlichen die Ubuntu-Entwickler alle 6 Monate STS Versionen,

die als Vorschau für interessiere Nutzer gedacht sind.

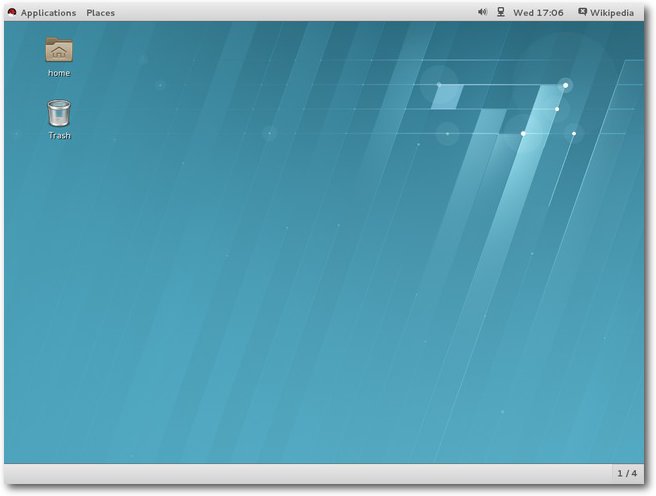

Screenshot von Ubuntu 14.04.2.

Die Ubuntu-Paketquellen sind in die Bereiche main, universe und multiverse

eingeteilt. In main liegen die offiziell von Canonical (der Firma hinter Ubuntu)

betreuten Pakete, in universe die von der Community gepflegten Programme.

Letztere kommen teilweise während des Entwicklungsprozesses durch einen

Synchronisationsvorgang aus dem Debian Testing- oder auch Unstable-Zweig. Zu den

verschiedenen Paketquellen sowie den Vor- und Nachteilen dieser Aufspaltung

siehe auch diesen Blogbeitrag [5].

Vorteile von Ubuntu:

- Der Support wird für 5 Jahre garantiert.

- Alle zwei Jahre erscheint planbar eine neue LTS-Version.

- In regelmäßigen Abständen werden sogenannte Pointreleases (z. B. 14.04.2) mit aktualisierter Hardwareunterstützung (Kernel und Grafikstack) veröffentlicht.

- Über die Personal-Package-Archives (PPA) können aktualisierte Softwarepakete eingespielt werden.

- Distributionsupgrades von einer LTS-Version auf die folgende sind möglich.

Nachteile von Ubuntu:

- Der LTS-Support wird lediglich für die Pakete in main garantiert. Die Pakete in universe können Unterstützung erhalten, dies wird aber nicht definitiv zugesichert.

- Die Unity-Oberfläche hat Vorrang. Probleme der anderen Desktopoberflächen – sei es im Releasemangement oder während der Supportzeit – werden nachrangig behandelt.

- Bei vielen eingebundenen PPAs können Upgrades zwischen den verschiedenen LTS-Versionen scheitern.

Eine deutschsprachige Community findet sich bei ubuntuusers.de [6].

Red Hat Enterprise Linux / CentOS / Scientific Linux

RedHat Enterprise Linux (RHEL) [7]

und die beiden aus dessen Quellen gebauten Community-Varianten CentOS [8]

und Scientific Linux [9] stehen zur Zeit an

der Spitze der LTS-Versionen – zumindest was die Supportdauer betrifft. Jede

Version von RHEL und des auf Binärkompatibilität ausgelegten Ablegers CentOS

durchläuft verschiedene Lebenszyklen, wird letztlich aber fast 10 Jahre mit

Sicherheitsaktualisierungen versorgt.

Screenshot von Red Hat Enterprise Linux.

Im Vergleich zu Debian oder Ubuntu haben RHEL und seine Ableger allerdings nur

ein relativ eingeschränktes Paketangebot. Mit GNOME gibt es lediglich einen

unterstützten Desktop und auch die restliche Software für den Desktopeinsatz ist

stark auf Büroarbeitsplätze ausgerichtet. Zwar können die bestehenden Lücken

durch externe Quellen kompensiert werden, dies läuft allerdings grundsätzlich

dem LTS-Gedanken zuwider.

In relativ regelmäßigen Abständen bringt RedHat eine neue Minorversion (z. B.

7.1) der Distribution heraus. Bei dieser wird zwar der – extrem stark

modifizierte – Kernel stabil gehalten, aber viele Softwarepakete bis hin zu

X.Org aktualisiert. Dadurch funktioniert auch neuere Hardware noch mit einer

vergleichsweise alten Distribution wie z.B: RHEL 6, das ursprünglich 2010

erschien und noch bis 2020 unterstützt wird.

Vorteile von RHEL und seinen Ablegern:

- Extrem langer Support von bis zu 10 Jahren.

- Regelmäßige Minor-Releases passen die Version an aktuelle Hardware an.

- RedHat pflegt die vorhandenen, nicht besonders zahlreichen, Pakete intensiv über die gesamte Lebensdauer.

Nachteile von RHEL und seinen Ablegern:

- Das Softwareangebot ist sehr beschränkt.

- Die Softwareversionen sind im eigentlichen Sinne nicht stabil, da mit jedem Minorrelease viele Programmversionen angehoben werden (Kernel und Desktop ausgenommen).

- Es sind keine Distributionsupgrades zwischen den Hauptversionen (z. B. 6 nach 7) möglich.

SUSE Linux Enterprise Desktop

Der SUSE Linux Enterprise Desktop (SLED) [10] ist das

Gegenstück der traditionsreichen Firma SUSE aus Nürnberg zu RedHats RHEL. Im

Gegensatz zu diesem gibt es aber keinen Community-Ableger und somit auch keine

kostenfreie Version. Die genaue Supportdauer variiert innerhalb der

Produktfamilie etwas, beläuft sich aber ebenfalls auf ca. 10 Jahre.

Vor einigen Jahren galt SUSE Linux noch als die KDE-Distribution, auch im

Enterprise-Bereich. Diese Phase ist jedoch Geschichte und mit der gegenwärtigen

Version 12 liefert die SUSE nur noch ein angepasstes GNOME 3 aus.

Die Version wurde bisher um sog. „Service Packs“ ergänzt, wie man sie aus der

Windows-Welt kannte. Mit Version 12 wurden nun „Module“ eingeführt, z. B. das Web

and Scripting Module mit PHP, Python und Ruby on Rails. Die Laufzeit für diese

einzelnen Module beträgt lediglich 1-3 Jahre, danach muss auf eine neue

Modulversion aktualisiert werden. Dadurch ist es gerade im Serverbereich möglich,

wichtige Basistechnologien aktuell zu halten, die Distribution ist im

eigentlichen Sinne jedoch nicht mehr stabil, da sich die Versionen während der

Lebenszeit ändern.

Vorteile von SLED:

- Extrem lange Supportdauer.

- YaST

- Durch Module bzw. bis Version 11 Service Packs können wichtige Pakete verhältnismäßig aktuell gehalten werden.

Nachteile von SLED:

- Keine stabile Distribution im eigentlichen Sinne

- Undurchsichtige Supportdauer

- Keine planbaren Releasezyklen

- Kein freier Community-Ableger

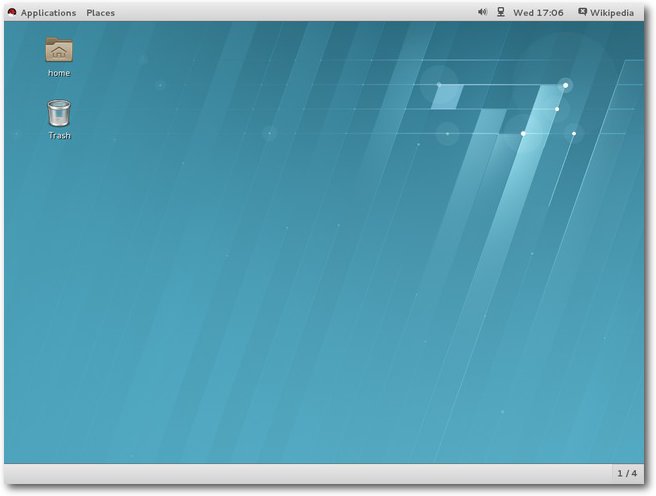

openSUSE Evergreen

OpenSUSE [11] ist die freie Community-Version von

SUSE, allerdings nicht binärkompatibel zum kommerziellen SLED (siehe oben). Die Distribution bildet ähnlich

wie Fedora lediglich die Basis für die Enterprise Version. OpenSUSE hat

traditionell recht lange Supportzeiträume für eine reguläre Distribution.

Die openSUSE-Community pflegt immer den aktuellen plus den vorangegangenen Release.

Bei der Veröffentlichung einer neuen Version wird die nun obsolete vorvorletzte

Version noch zwei Monate gepflegt, um den Nutzern den Übergang zu ermöglichen.

Durch die seit einigen Jahren immer ausgedehnteren Zeiträume zwischen zwei

Versionen kommen hier beachtliche Supportzeiträume zustande. OpenSUSE 13.1 wurde

z. B. im November 2013 veröffentlicht und wird bis dato gepflegt, da

Version 13.3 noch nicht angekündigt ist.

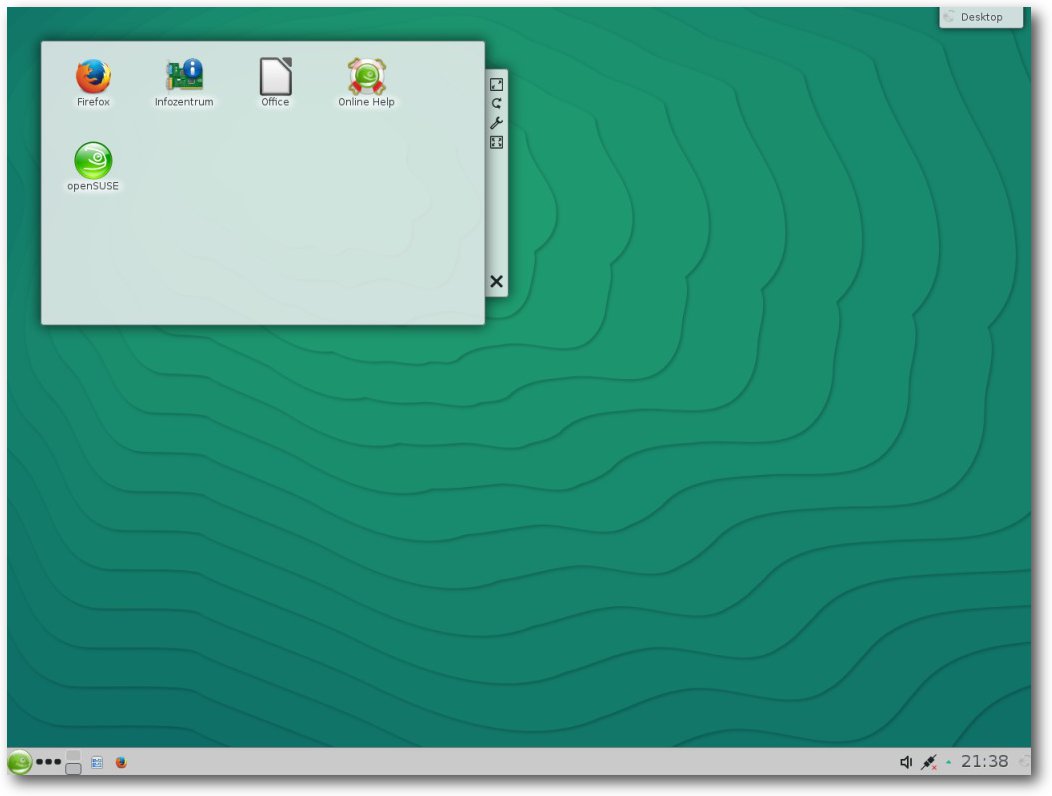

Screenshot von openSUSE Evergreen.

Aufgrund des fehlenden kostenlosen Ablegers der Enterprise-Distribution SLED gibt

es das Community Projekt Evergreen für openSUSE, das den Supportzeitraum von

openSUSE über das eigentliche Ende hinaus verlängert. Das Projekt wird

maßgeblich gestützt durch Personen, die openSUSE beruflich einsetzen und in

dieser Funktion abgekündigte Versionen pflegen. Durch das Projekt wird z. B. die

Version 13.1 planmäßig bis 2016 unterstützt und erreicht damit dieselbe

Supportdauer wie z. B. Debian.

Vorteile von openSUSE Evergreen:

- Relativ umfangreiche Paketquellen

- YaST

- Paketversionen werden in der Regel stabil gehalten.

Nachteile von openSUSE Evergreen:

- Supportzeitraum relativ kurz.

- Genauer Umfang des Evergreen-Supports unklar.

- Distributionsupgrades nicht garantiert.

Eine deutschsprachige Community für openSUSE Evergreen findet sich beim Linux Club [11].

Fazit

Jede hier genannte Distribution hat Vor- und Nachteile. Welche Distribution sich

am besten eignet, hängt von vielen Faktoren ab. Die gewünschte Desktopumgebung

(sofern ein Desktopeinsatz angestrebt wird), das Paketformat, der Zeitraum

der Unterstützung und die Anzahl mitgelieferter Pakete können hier

herangezogen werden. Dieser Artikel dient einer

Übersicht über die verschiedenen

Möglichkeiten, weil oftmals die Enterprise-Distributionen zu

Unrecht als untauglich für den Desktopeinsatz abgestempelt werden.

Links

[1] http://www.curius.de/blog/16-open-source/linux/34-linux-distributionen-mit-langzeitunterstuetzung-lts

[2] http://www.debian.org/

[3] https://debianforum.de/forum/

[4] http://www.ubuntu.com/

[5] http://www.curius.de/blog/16-open-source/linux/12-ubuntu-lts-nach-12-monaten-licht-und-schatten-beim-treuen-tahr

[6] http://ubuntuusers.de/

[7] http://www.redhat.com/de/technologies/linux-platforms/enterprise-linux

[8] https://www.centos.org/

[9] https://www.scientificlinux.org/

[10] https://www.suse.com/de-de/

[11] https://de.opensuse.org/Hauptseite

| Autoreninformation |

| Gerrit Kruse (Webseite)

([Mer]Curius) nutzt Linux seit 2007. Als Wissenschaftler stehen Datenschutz und

produktives Arbeiten auf dem Linux-Desktop im Vordergrund seiner Interessen.

|

Beitrag teilen Beitrag kommentieren

Zum Inhaltsverzeichnis

von Mathias Menzer

Basis aller Distributionen ist der Linux-Kernel, der fortwährend

weiterentwickelt wird. Welche Geräte in einem halben Jahr unterstützt werden und

welche Funktionen neu hinzukommen, erfährt man, wenn man den aktuellen

Entwickler-Kernel im Auge behält.

Die Entwicklung von Linux 4.1

Bereits bei der Freigabe von Linux

4.1-rc7 [1] stand fest, dass dies nicht die

letzte Entwicklerversion werden würde. Zwar ging die Zahl der Änderungen

abermals zurück, doch einige Probleme waren noch übrig. Unter den Änderungen

waren Fehlerkorrekturen im Bereich der Werkzeuge zur Leistungsmessung und eine

neue Selbsttest-Funktion für den

VM86-Modus [2], ein Relikt aus

frühen Tagen als Anwendungen noch Zugriff auf den ganzen Arbeitsspeicher

erhielten – aus heutiger Sicht sicherlich ein sicherheitstechnischer Alptraum.

Die achte und letzte Entwicklerversion [3]

gab Torvalds während seines Urlaubs frei. Die Umfangreichsten Änderungen war

hier die Umstellung der Parameterübergabe an die Funktion dma_buf_export(), die

künftig nicht mehr mittels vieler Parameter sondern einer einzelnen Struktur

erfolgt. Letztlich sind die benötigten Übergaben als einzelne Felder in dieser

Struktur enthalten, jedoch wird der Code und auch die Handhabung der Funktion

dadurch vereinfacht.

Ebenfalls dick aufgetragen hat die Rücknahme eines Patches, der eigentlich als

Vorbereitung für die Unterstützung der Verschlüsselungs- Hardwarebeschleunigung

CESA (Cryptographic Engine and Security Accelerator) gedacht war. Allerdings

hatte die Umsetzung auf einigen Systemen zu Problemen mit Direct Memory

Access [4], einer

Funktion die Geräten einen direkten Zugriff auf den Arbeitsspeicher ohne Umweg

über den Prozessor ermöglicht, geführt und wurde daher vor der Veröffentlichung

der finalen Version entfernt.

Die wurde dann auch eine Woche später

freigegeben [5]. Nur 36 Änderungen kamen

zusammen, wovon das meiste auf Korrekturen an Grafik und Sound-Treibern

zurückzuführen war.

Der Kernel Linux 4.1

Insgesamt hat die Entwicklung von Linux 4.1 71 Tage gedauert und liegt damit

etwas über dem Durchschnitt der letzten vier Jahre. Fast 13.000 Änderungen kamen

dabei zusammen und brachten diesmal wieder ein paar interessante Neuerungen

hervor.

Einer der wichtigsten Punkte des neuen Kernels dürfte jedoch die Tatsache sein,

dass er von Greg Kroah-Hartman als neuer Longterm Release Kernel ausgewählt

wurde [6]. Kroah-Hartman wird die Unterstützung für Linux

3.10 im Herbst nach zwei Jahren einstellen, und stattdessen 4.2 bis 2017 mit

Patches pflegen.

Die populärste Neuerung dürfte die eingebaute Verschlüsselung für

ext4 [7] sein. Zwar stehen schon seit längeren

Möglichkeiten wie dm-crypt [8],

ecryptfs [9] oder

EncFS [10] zur Verfügung um Datenträger zu

verschlüsseln, bei denen entweder das reguläre Dateisystem in einen

verschlüsselten Container gelegt oder verschlüsselte Dateien in einem regulären

Dateisystem gespeichert werden. Die Integration der Verschlüsselung direkt in

das Dateisystem spart Ressourcen – es ist eine Komponente weniger an den

Dateizugriffen beteiligt.

Die ext4-Verschlüsselung kann mit mehreren Schlüsseln pro Dateisystem arbeiten,

was die Voraussetzung für die Nutzbarkeit durch mehrere Anwender ist.

Grundsätzlich wird Datei- oder Verzeichnisweise verschlüsselt, jedoch nur der

Inhalt, Metadaten wie Berechtigungen, Größe und Zeitstempel liegen weiterhin in

lesbarer Form vor.

ACPI [11]

ist auf heutigen Systemen der gängige Standard, wenn es um die Energieverwaltung

und Gerätekonfiguration dar – zumindest im x86-Umfeld. Auf ARM-Seite wird

Unterstützung für ACPI kontrovers betrachtet und es werden andere Ansätze zur

Geräte-Erkennung und -Konfiguration bevorzugt. Die Unterstützung der

ARM64-Architektur für ACPI wurde ohne viel Aufsehen zu erregen umgesetzt. Es

könnte jedoch sein, dass Hardwarehersteller auf diesen Zug aufspringen und bald

Server mit ARM64-Prozessoren und ACPI anbieten – angesichts der Effizienz

ARM-basierter Systeme würde dies durchaus Sinn ergeben.

Nichtflüchtige Speicher (Non-Volatile RAM,

NVRAM) [12]), d. h. Flash-Speicher, die ihre Daten

nicht verlieren, wenn sie stromlos werden, waren bereits bei Linux 4.0 ein Thema

(siehe „Der April im Kernelrückblick“, freiesMagazin

05/2015 [13]). Damals wurde eine

Funktion in ext2, die die sinnvolle Nutzung solcher Speicher erlaubte, durch

eine überarbeitete ersetzt: DAX (Direct Access). Die aktuelle Kernel-Version

bringt mit PMEM einen neuen Treiber mit, der die Unterstützung für

nichtflüchtige Speicher weiter verbessern soll.

PMEM ermöglicht es, NVRAM als Block-Gerät in einem reservierten Speicherbereich im

Virtuellen Speicher [14]

einzubinden. Dadurch lässt es sich zwar wie regulärer Arbeitsspeicher

ansprechen, jedoch weiß die Speicherverwaltung, bei welchen Bereichen es sich um

NVRAM handelt und kann diesen dann anders behandeln, beispielsweise durch das

zwischenspeichern bei Schreiboperationen, um die vielen Schreibvorgänge pro

Sekunde auf den NVRAM selbst zu reduzieren. Dadurch ließe sich die Lebensdauer

der meist auf Flash-Technologie beruhenden NV-Speicher verlängern.

Btrfs hat einige Korrekturen erhalten, die jedoch in erster Linie Nutzer

betreffen, die damit Dateisysteme ab 20 TB Größe betreiben oder mit Dateien ab 3

TB arbeiten – beide Fälle werden vermutlich nur sehr wenige Anwender außerhalb

von Unternehmen betreffen. Das Dateisystem XFS kann nun mit dem Overlay-

Dateisystem UnionFS [15] zusammenarbeiten und

erlaubt nun, „Löcher“, also einen leeren Bereich, in eine Datei einzufügen, der

dann ggfs. später gefüllt werden kann.

Netzwerkseitig unterstützt Linux nun eine neue Methode zur Generierung von

Interface-Kennungen, die für die Erstellung von

IPv6 [16]-Adressen benötigt werden. Diese neue

Methode basiert nicht auf der

MAC-Adresse [17] des jeweiligen

Interfaces und stellt damit eine geringere Gefahr für

die Privatsphäre des Anwenders dar. Die erzeugten „Interface Identifier“ sind

innerhalb eines Subnetzes gleich, ändern sich jedoch, wenn das Netzwerk,

beispielsweise das WLAN, gewechselt wird.

Links

[1] https://lkml.org/lkml/2015/6/7/219

[2] https://de.wikipedia.org/wiki/Virtual_8086_Mode

[3] https://lkml.org/lkml/2015/6/14/250

[4] https://de.wikipedia.org/wiki/Speicherdirektzugriff

[5] https://lkml.org/lkml/2015/6/22/8

[6] http://heise.de/-2681151

[7] https://de.wikipedia.org/wiki/ext4

[8] https://de.wikipedia.org/wiki/Dm-crypt

[9] https://de.wikipedia.org/wiki/ECryptfs

[10] https://de.wikipedia.org/wiki/EncFS

[11] https://de.wikipedia.org/wiki/Advanced_Configuration_and_Power_Interface

[12] https://de.wikipedia.org/wiki/NVRAM

[13] http://www.freiesmagazin.de/freiesMagazin-2015-05

[14] https://de.wikipedia.org/wiki/Virtuelle_Speicherverwaltung

[15] https://de.wikipedia.org/wiki/UnionFS

[16] https://de.wikipedia.org/wiki/IPv6

[17] https://de.wikipedia.org/wiki/MAC-Adresse

| Autoreninformation |

| Mathias Menzer (Webseite)

behält die Entwicklung des Linux-Kernels im Blick, um über kommende Funktionen

von Linux auf dem Laufenden zu bleiben und immer mit interessanten Abkürzungen

und komplizierten Begriffen dienen zu können.

|

Beitrag teilen Beitrag kommentieren

Zum Inhaltsverzeichnis

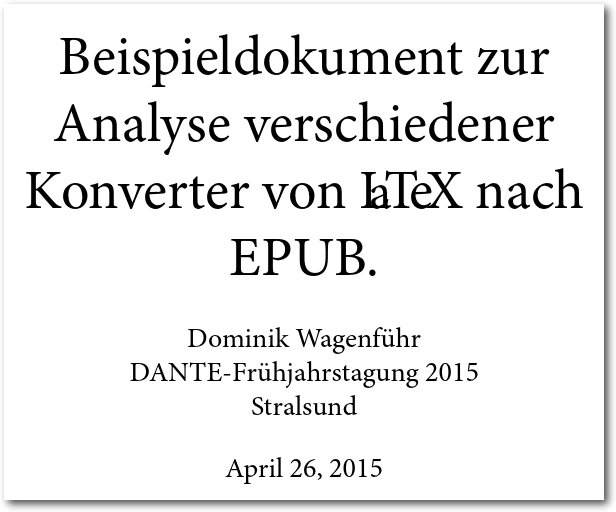

von Dominik Wagenführ

E-Book-Reader und mobile Geräte, auf denen man E-Books lesen kann, werden

immer beliebter, nehmen sie doch weniger Platz in der Reisetasche weg als

herkömmliche Bücher. Und so haben auch immer mehr Autoren, die LaTeX nutzen,

Interesse daran, ihre Werke nicht nur als PDF, sondern auch in einem

E-Book-Format zu veröffentlichen. Der Artikel wirft einen Blick auf die

aktuellen Möglichkeiten, ein LaTeX-Dokument in ein EPUB zu konvertieren.

Hinweis: Alle Programme und Beispiele aus dem Artikel wurden unter Ubuntu

14.04 LTS ausgeführt und getestet. Auf anderen Betriebssystemen kann es ggf.

die eine oder andere Konvertiermöglichkeit nicht geben bzw. sie mag dort

anders heißen. Zusätzlich kann es ggf. neuere Versionen der getesteten

Programme geben, die eine größere Funktionalität besitzen.

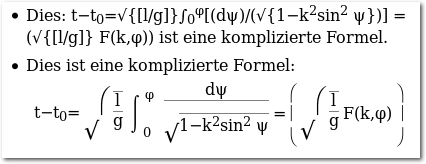

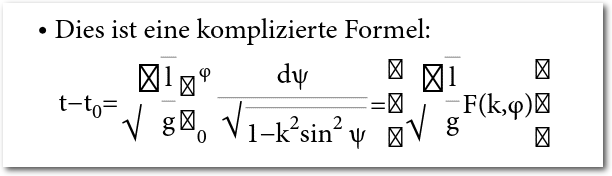

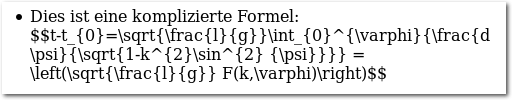

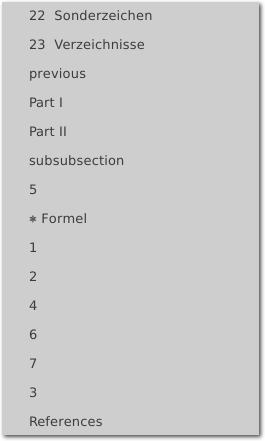

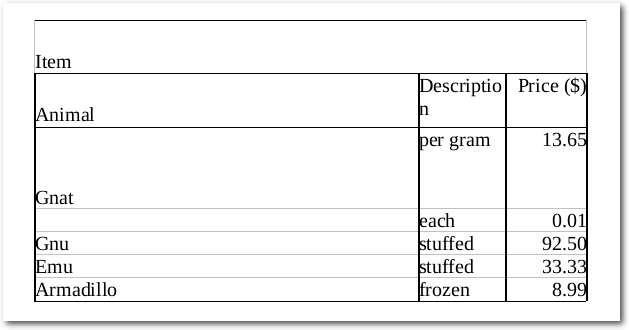

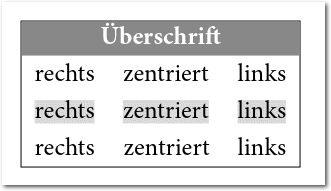

Beispieldokument

Im Gegensatz zum Artikel „E-Book-Erstellung aus LaTeX und HTML“,

freiesMagazin 11/2012 [1],

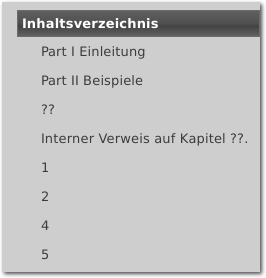

in dem es konkret um die Umwandlung eines Magazins in EPUB ging, soll der

vorliegende Artikel sich mit herkömmlichen Studienarbeiten beschäftigen.

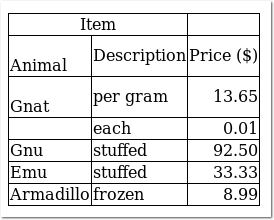

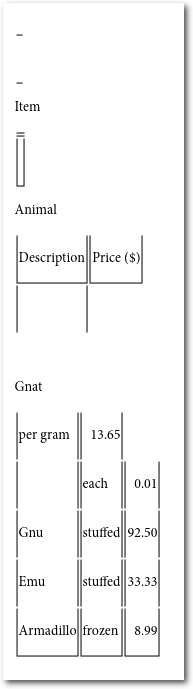

Aufgrund dessen wurde ein Beispieldokument erstellt, welches die

meistgenutzten Elemente wissenschaftlicher Arbeiten und Aufsätze enthält,

wie sie im Schul- bzw. Universitätsbetrieb vorkommen. Zu den verwendeten

Elementen gehören unter anderem

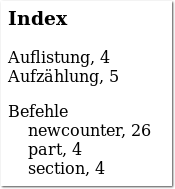

- Titelseite

- Inhaltsverzeichnis

- Überschriften in verschiedenen Ebenen

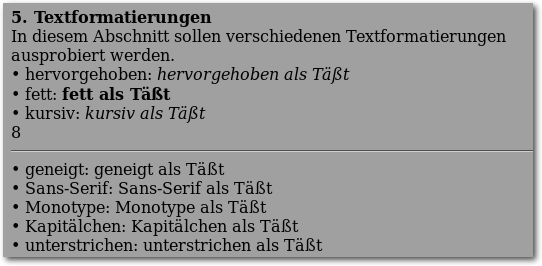

- Textauszeichnungen und Schriftgrößen

- Aufzählungen und Auflistungen

- Interne und externe Verweise

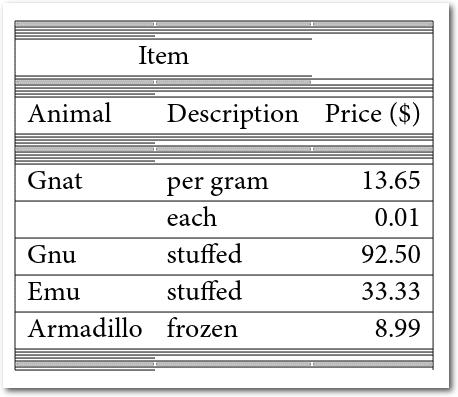

- Tabellen und Tabellenverzeichnis

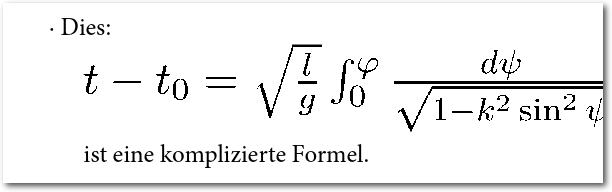

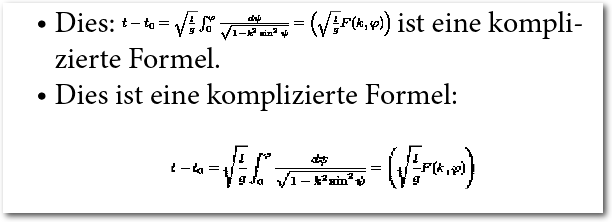

- Mathematische Formeln

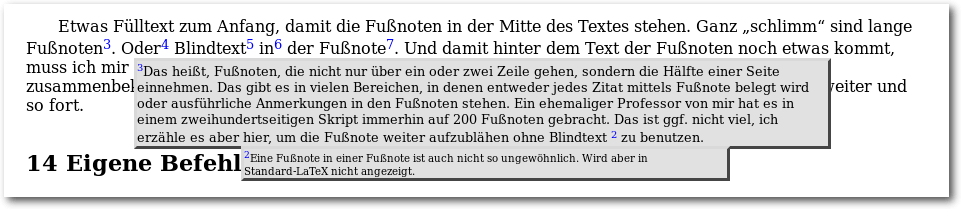

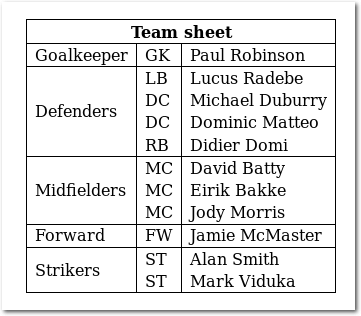

- Fußnoten

- Bilder, Abbildungen und Abbildungsverzeichnis

- Zitate und Quellverzeichnis

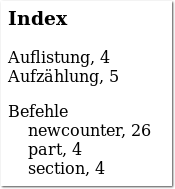

- Index-Angabe/Glossar

- Definition von eigenen LaTeX-Kommandos und LaTeX-Umgebungen

Das Dokument liegt als Beispiel zum Download vor:

EPUB-LaTeX-Beispiel.tar.gz. Es kann mit latex bzw. pdflatex

übersetzt werden:

$ latex epub_latex_beispiel

$ pdflatex epub_latex_beispiel

Den Lauf muss man gegebenenfalls wiederholen und vorher makeindex bzw. bibtex

laufen lassen, um Stichwort- und Quellverzeichnis zu generieren:

$ makeindex epub_latex_beispiel

$ bibtex epub_latex_beispiel

Hinweis: Der Kürze halber wird im Artikel nur der Dateiname beispiel.*

benutzt, anstatt des kompletten epub_latex_beispiel.*. Für ganz Faule

liegt dem Archiv auch ein Makefile bei, über welches man mittels

make-Aufruf das Dokument übersetzen und danach konvertieren kann.

Besonderheiten eines E-Books

Auch wenn die meisten Leser sicherlich schon einmal ein Buch aus Papier in

den Händen gehalten haben, ist man sich oft der Eigenschaften, die so ein

Buch mitbringt, nicht bewusst. So gibt es feste Seiten, in der Regel mit

Seitenzahlen am Rand oder in den Ecken. Rand? Genau, einen Rand um den

eigentlichen Textkörper gibt es auch. So kann man das Buch mit den Händen

festhalten, ohne dass der Text verdeckt wird. Oder man kann Kommentare mit

einem Stift an den Seitenrand schreiben. Für ältere Menschen ist dieses

feste Format aber eher schlecht. Die Schriftgröße verschiedener Bücher ist

oft viel zu klein, sodass man sich externer Hilfen wie Lupen bedienen muss.

Diese Eigenschaften treffen natürlich nicht nur auf gedruckte Bücher zu,

sondern auch teilweise auf „starre“ digitale Formate, wie z. B. das PDF.

Ein E-Book [2] dagegen ist nicht starr.

Ganz im Gegenteil kann man es sogar als „fließend“ bezeichnen. Die

Schriftgröße oder auch die Schriftart lassen sich oft so einstellen, dass

man ohne Probleme auch bei einer Sehschwäche lesen kann. Man kann in einem

E-Book zwar auch von Seite zu Seite blättern, dabei sind die Seitenzahlen

aber nicht fest. Sie richten sich danach, wie groß der Text auf einer

einzelnen Seite ist. Je nach Darstellungsart hat ein Buch also bei einem

Leser 100 Seiten und bei einem anderen vielleicht 150.

Ein weiterer Unterschied zwischen E-Books und Büchern ist die Möglichkeit

der Verlinkung und der Suche. In der analogen Welt muss man sich mit einem

Index zufrieden geben und hoffen, dass der Autor alle wichtigen Stellen

indiziert hat. Ansonsten ist viel Blättern angesagt. Bei digitalen Formaten

dagegen kann man von einem Index über Links direkt an die gewünschte Stelle

im Buch springen oder auch einfach den ganzen Text in Sekundenbruchteilen

durchsuchen.

Warum nicht das PDF nutzen?

Auf den meisten E-Book-Readern kann man auch direkt PDFs lesen. Wieso also

nicht das von LaTeX erstellte PDF-Dokument auf dem Reader lesen? Der Grund

ist, dass PDF wie oben erwähnt ein starres Format ist. Das heißt, der

E-Book-Reader zeigt eine ganze Seite an, die in der Regel in DIN A4 erstellt

wurde. Würde man auf einem kleinen Display die ganze Seite anzeigen, könnte

man nichts mehr erkennen. Wenn man also etwas lesen will, muss man in den

Text zoomen und ggf. sehr oft hin- und herscrollen, was bei den meisten

E-Book-Readern keinen großen Spaß macht.

Insgesamt gehen mit einem PDF viele Vorteile von mobilen Formaten verloren,

weswegen EPUB [3] das bevorzugte Format ist.

Dieses hat sich in den letzten Jahren als dominierend erwiesen und so gut

wie alle Hersteller von E-Book-Readern verstehen dieses Format.

EPUB ist ein gepacktes Container-Format, in welchem man die XHTML-kodierten

Dateien (wie bei gewöhnlichen Webseiten) findet, welche den Text sowie die

Formatierung angeben. Daneben enthält der Container natürlich auch die

anzuzeigenden Bilder sowie im EPUB3-Standard auch noch Audio- und Videoelemente.

Zusätzlich kann man auch noch ein Inhaltsverzeichnis und andere Meta-Daten

(wie Autoren, Herausgeber etc.) in dem Container ablegen. Da ein EPUB also

intern auch nur aus HTML-Seiten besteht, drängt sich der Weg über eine

HTML-Wandlung geradezu auf.

Naive Wandlung des PDFs als E-Book

Wenn man das Beispieldokument in ein PDF übersetzt hat, kann man versuchen,

dieses direkt in ein EPUB oder in HTML zu wandeln. Dies geht beispielsweise

über

$ pdftohtml beispiel.pdf beispiel.html -noframes

Das Ergebnis ist dabei aber nicht wirklich ansehnlich: Es fehlen Absätzen

und Einrückungen, Formatierungen gehen verloren und Seitenzahlen werden in

den Text gedruckt, obwohl es gar keine Seiten mehr gibt.

Die Konvertierung des PDF in HTML sieht unschön aus und viele Formatierungen gehen verloren.

Eine Alternative ist das bekannte Konvertierungsprogramm

Calibre [4]. Dabei ist Calibre selbst eher ein

Medienverwaltungsprogramm, welches aber zahlreiche Hilfsmittel und Skripte

mitbringt. Eines davon,

ebook-convert [5],

beherrscht viele Wandlungen, unter anderem auch PDF nach EPUB:

$ ebook-convert beispiel.pdf beispiel.epub

Öffnet man das entstandene EPUB (zum Beispiel mit dem Calibre beiliegenden

Programm ebook-viewer oder auf dem E-Book-Reader) bietet sich ein

ähnliches Bild wie bei pdftohtml: Einrückungen und Formatierungen gehen

teilweise verloren und die PDF-Seitenzahl unterbricht den Lesefluss.

Die Wandlung des PDFs nach HTML beziehungsweise EPUB bietet sich also nicht an. Zu

viele Informationen gehen durch die PDF-Elemente verloren, die in LaTeX noch

zu finden sind. Daher ist die Idee, das LaTeX-Dokument direkt ohne Umwege zu wandeln.

EPUB-Erstellung aus HTML

Wenn man mit Hilfe der weiter unten vorgestellten Programme eine HTML-Datei

aus dem LaTeX-Dokument erzeugt hat, gibt es ebenfalls verschiedene

Möglichkeiten, wie man aus der HTML-Datei ein EPUB generieren kann.

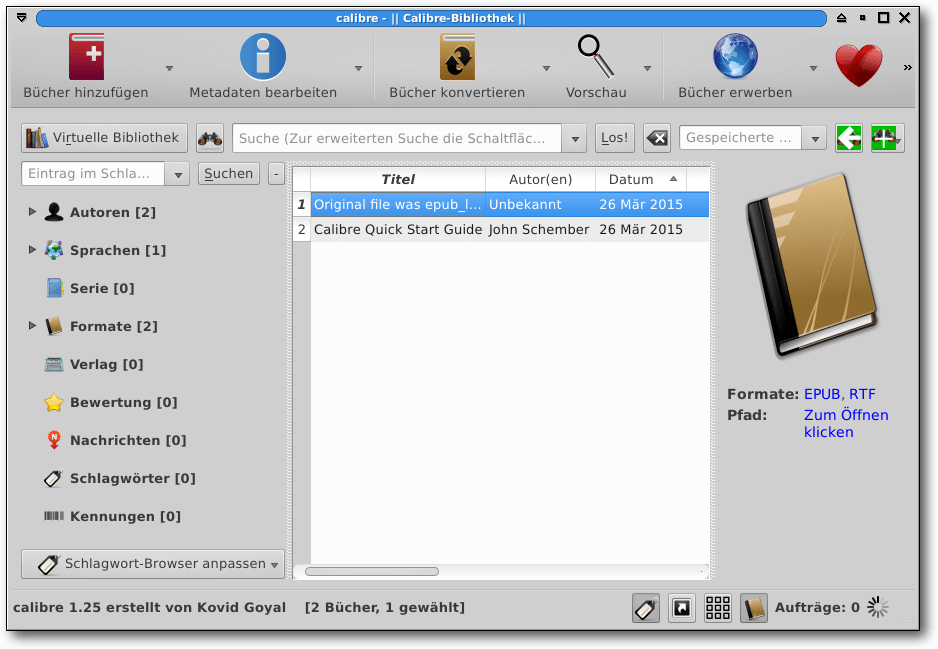

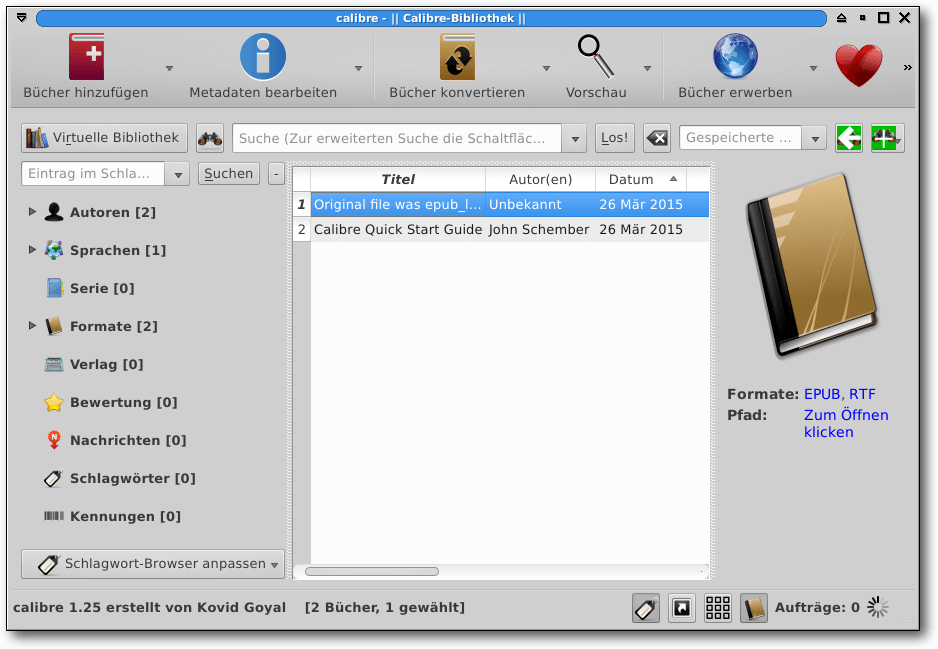

Calibre

Man kann dazu das bereits oben erwähnte Calibre nutzen:

$ ebook-convert beispiel.html beispiel.epub --no-default-epub-cover

Die Option --no-default-epub-cover bietet sich dabei an, wenn man wie im

Beispiel eine eigene Titelseite hat und kein separates Deckblatt benötigt.

Alternativ dazu besitzt Calibre auch eine grafische Oberfläche, mit der man die

Wandlung vornehmen kann. Hierzu klickt man auf „Bücher hinzufügen“ oben

links und wählt dann die HTML-Datei aus. Danach selektiert man das neu

hinzugefügte Buch in der Titelliste in der Mitte und klickt oben auf

„Bücher konvertieren“. Voreingestellt sollte oben rechts „EPUB“ sein.

Daneben kann man noch das Titelbild, Inhaltsverzeichnis, Metadaten und

einige anderen Einstellungen verändern. Mit dem Klick auf „OK“ wird das

Buch dann konvertiert und steht anschließend auch als EPUB zur Verfügung.

Die grafische Oberfläche von Calibre.

Sigil

Ein zweites Konvertierungsprogramm ist Sigil [6].

Sigil befindet sich in sehr aktiver Entwicklung, was leider auch seine

Nachteile mit sich bringt. So gab es bis zu Version 0.5.3 eine undokumentierte

Schnittstelle, um das Programm von der Konsole aus auszurufen und

Konvertierungen vorzunehmen. Diese Möglichkeit ist mit Version 0.6.0

weggefallen und wurde leider auch nicht wieder

eingebaut [7].

Daneben ist die neueste Version von Sigil so neu (das heißt es benötigt sehr neue

Bibliotheken), dass es auf einem ein Jahr alten Linux-System nicht mehr zu

übersetzen ist, sodass nicht näher auf das Programm eingegangen wird. Wer

will, kann es aber bei sich daheim testen.

Pandoc

Pandoc [8] will nach eigener Aussage das

Schweizer Armeemesser unter den Konvertierungsprogrammen sein. Es

unterstützt die direkte Konvertierung von LaTeX-Dokumenten, auf die weiter

unten eingegangen wird. Man kann mit Pandoc aber auch aus einer HTML-Datei

ein EPUB erstellen:

$ pandoc -o beispiel.epub beispiel.html

Das Ergebnis hat leider auch bei einer korrekten HTML-Datei als Eingabe die

Auswirkung, dass nicht alle Elemente übernommen werden. So werden

verschiedene Schriftgrößen gleich hoch dargestellt und Tabellen werden nicht

korrekt ins EPUB übernommen. Ebenso problematisch ist, dass ab und zu kein

valides Inhaltsverzeichnis im EPUB eingefügt wird, was aber auch mit dem

HTML-Dokument zu tun hat, sodass dieses Phänomen nur manchmal auftrat.

Aus diesen Gründen wird im Folgenden nur auf Calibre zur Konvertierung von HTML

nach EPUB eingegangen.

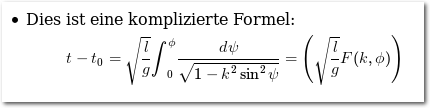

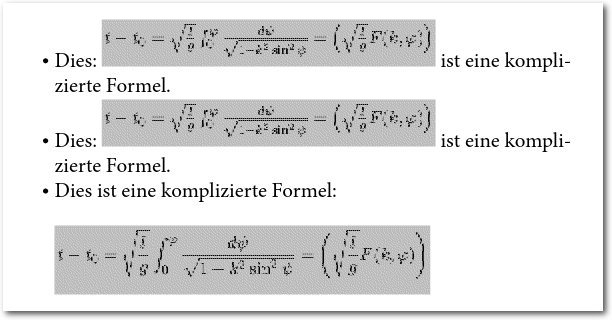

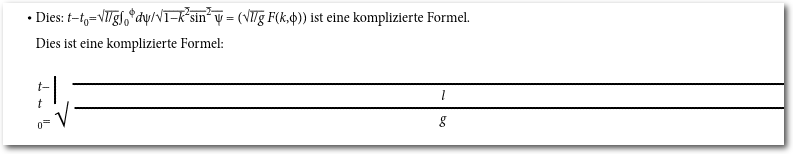

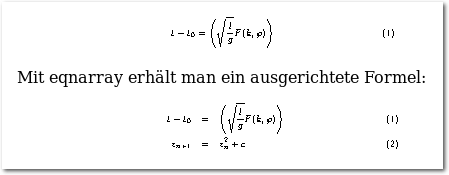

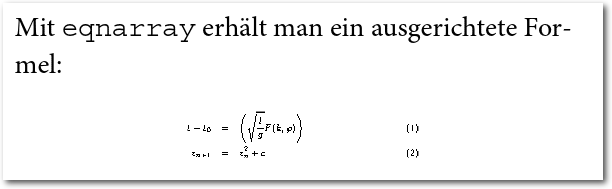

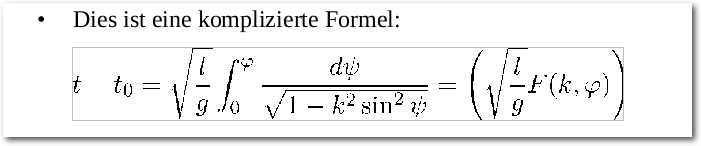

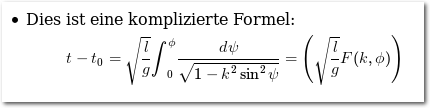

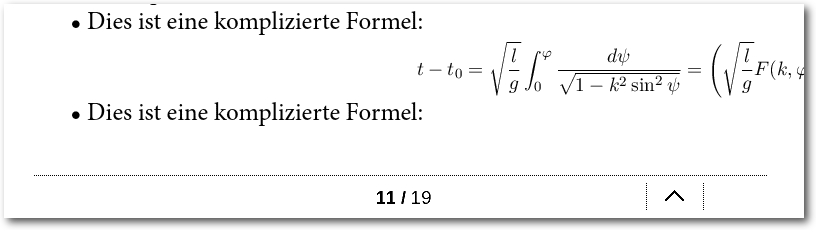

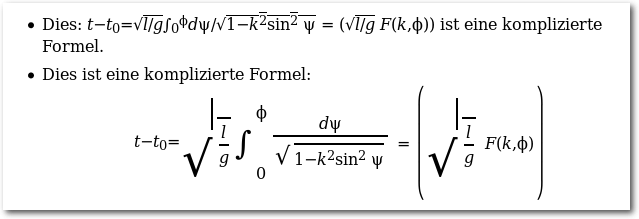

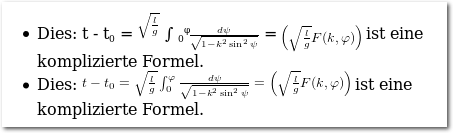

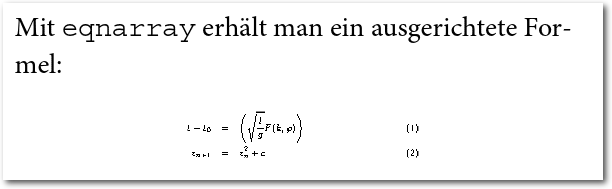

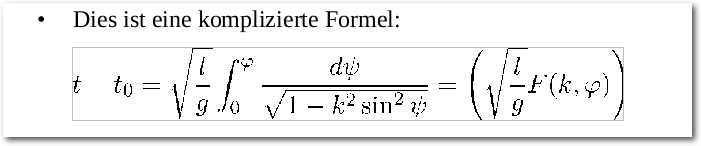

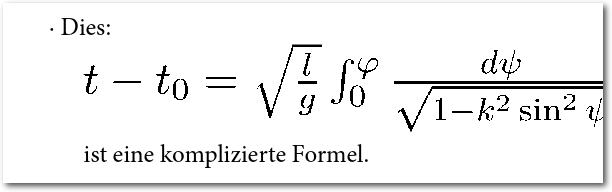

Besonderheit von MathML

Eine Besonderheit, über die man sich vor der Konvertierung in HTML bzw. ein

EPUB Gedanken machen muss, ist die Darstellung von mathematische Formeln,

wenn man diese in seinem Dokument nutzt. Für Browser steht unter anderem

hierfür die Auszeichnungssprache

MathML [9] zur Verfügung, die auch in

Verbindung mit HTML benutzt werden kann.

MathML im Browser.

Die Ausgabe von MathML ist sehr schön, hat für ein E-Book aber einen großen

Nachteil: Die meisten E-Book-Reader können kein MathML interpretieren.

MathML ist (noch) nicht Teil des EPUB-Standards und wird somit im Reader

entweder nur schematisch dargestellt oder der Reader bricht die Darstellung

komplett ab.

Das Ergebnis von Konvertern, die Formeln aus LaTeX nur nach MathML

exportieren können, wird zwar in HTML sehr gut aussehen, aber im EPUB nicht

mehr dargestellt werden Können. Weiter unten wird sich zeigen, welches

Programm eine alternative Darstellungsmöglichkeit hat.

HTML- und EPUB-Erstellung

Im Folgenden werden einige Programme vorgestellt, mit denen das

LaTeX-Beispieldokument in HTML gewandelt werden kann und auf die

Besonderheiten beziehungsweise etwaige Fehler eingegangen. Bei allen

Programmen gilt, dass diese oft eine Fülle an Optionen mitbringen,

sodass gegebenenfalls nicht die richtigen Parameter gefunden wurden,

um die HTML-Ausgabe optimal zu gestalten. Dennoch merkt man an den

rudimentären Aufrufen bereits, ob man mehr Zeit in die Konfiguration

eines Programms stecken will oder eher nicht.

Zu jedem Programm wird auf einige Besonderheiten eingegangen, was gut oder

weniger gut funktioniert. Eine detaillierte Auflistung aller Ergebnisse gibt

es in folgendem Dokument: EPUB-Konverter-Vergleich.ods. Dort werden die

Eigenschaften aller getesteten Programme im Detail erläutert.

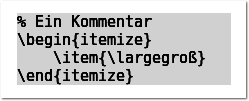

TtH

TtH [10] ist ein „TeX to HTML

translator“, der seit 1997 aktiv von Ian Hutchinson entwickelt wird. Der

Quellcode des Programms liegt zwar offen vor, aber nicht unter einer freien

Lizenz. Das Programm existiert für Linux, Windows und MacOS X. Die neueste

Version ist 4.07 vom 12.02.2015.

Die Benutzung ist recht einfach:

$ ./tth -w2 -u -a -e2 beispiel.tex

Die Option -w2 ist für die Ausgabe als XHTML 4.0. Die Option -u sorgt

für Unicode-Support, wobei aber der Charset im HTML-Dokument dennoch nicht

auf UTF-8 gesetzt wird, was dazu führt, dass beispielsweise deutsche Umlaute

per Standard nicht korrekt dargestellt werden. Hier muss man im Browser erst

manuell auf Unicode umstellen. Die Option -a sorgt dafür, dass ein

LaTeX-Lauf durchgeführt wird, der die notwendigen Verzeichnisse erstellt.

Die letzte Option -e2 sorgt dafür, dass Bilder inline eingebunden werden.

Es gibt noch eine zweite Version namens

TtM [11]. Diese ist identisch zu

TtH, bis auf dass mathematische Formeln nicht als Text sondern als MathML im

HTML dargestellt werden. Da MathML aber in einem EPUB nicht angezeigt

werden kann (siehe oben), wird nicht weiter auf diese Version eingegangen.

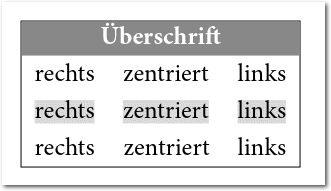

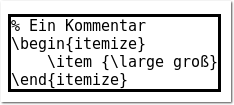

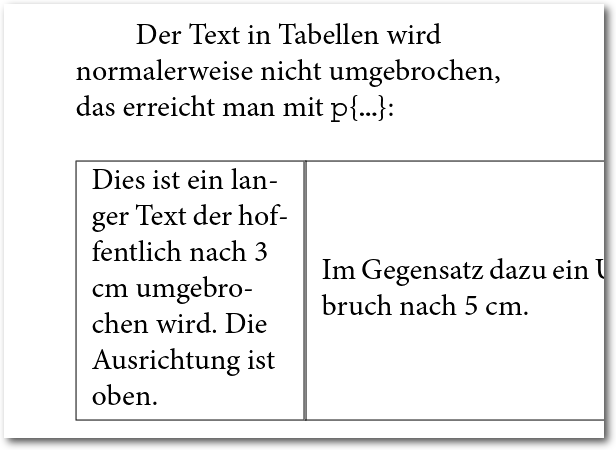

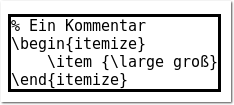

Wandlung in HTML

TtH arbeitet mit Lex [12]

und hat einen fest eingebauten Sprachschatz, der aber recht ausgeprägt

ist. Dadurch werden aber \documentclass und

\usepackage ignoriert und man kann keine weitere Pakete

laden. Ansonsten unterstützen beide Programme vom Anwender definierte

Kommandos und Umgebungen, was sehr hilfreich ist. Bei unbekannten

Kommandos und Umgebungen wird der Inhalt als Reintext wiedergegeben,

sodass zwar vielleicht das Layout, aber zumindest nicht die Information

verloren geht.

Alle Verzeichnisse werden korrekt eingebunden, erscheinen aber leider nur

mit englischer Bezeichnung (das heißt „List of Figures“ anstatt

„Bildverzeichnis“). Die Fußnoten werden am Ende des Dokuments angezeigt

und enthalten auch einen praktischen Backlink auf die Stelle, an der sie

definiert wurden. Auch alle anderen Verzeichnisse enthalten solche

Backlinks. Ein Fehler lässt leider alle Links im Stichwortverzeichnis

ins Leere gehen.

Grafiken als JPG und PNG werden direkt eingebunden, PDF- und EPS-Grafiken

werden aber nur verlinkt. Diese kann man aber vorher manuell konvertieren,

wenn das gewünscht ist:

$ pdftops fm-logo_pdf.pdf

$ ps2png fm-logo_pdf.ps fm-logo_pdf.png

$ epspdf fm-logo_eps.eps

$ pdftops fm-logo_eps.pdf

$ ps2png fm-logo_eps.ps fm-logo_eps.png

TtH erkennt diese zugehörigen Dateien dann automatisch und bindet die

Bitmap-Versionen anstelle des PDF- oder EPS-Links ein.

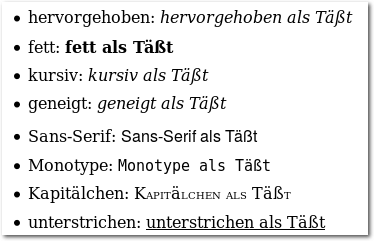

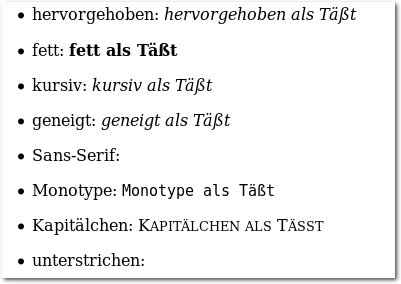

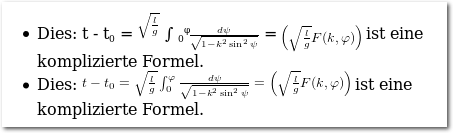

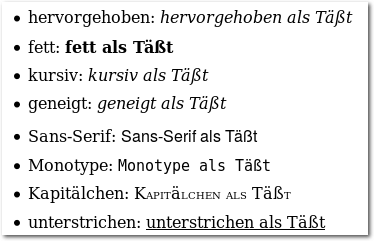

Von den Überschriften und Textauszeichnungen wird alles unterstützt, wobei

kursiv und geneigt grundsätzlich bei allen getesteten Programmen identisch

als kursiv dargestellt werden. Bei Kapitälchen gibt es Probleme mit

deutschen Umlauten, die in der Standardschrift ausgegeben werden. Auch

verschiedene Schriftgrößen werden unterstützt.

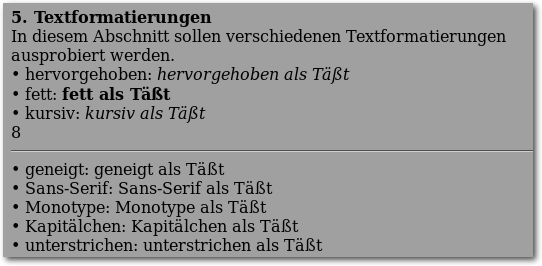

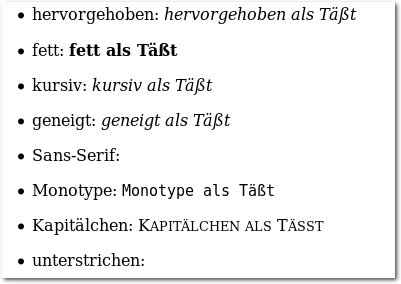

Textauszeichnungen und -formatierung.

Bei der Ausrichtung von Text gibt es hier die Besonderheit, dass der

gesamte Text grundsätzlich nur als linksbündiger Flattersatz ohne Einzug

ausgegeben wird, was für ein HTML-Dokument aber in der Regel auch eine

bessere Darstellungsmöglichkeit als Blocksatz ist. Der Grund dafür

liegt darin, dass HTML-Dokumente in Blocksatz meist zu sehr großen Abständen

zwischen den Wörtern neigen.

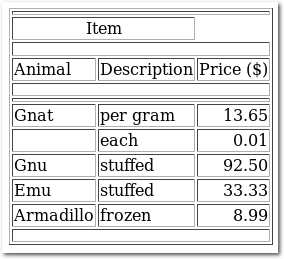

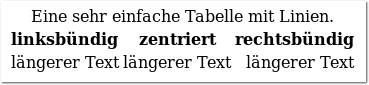

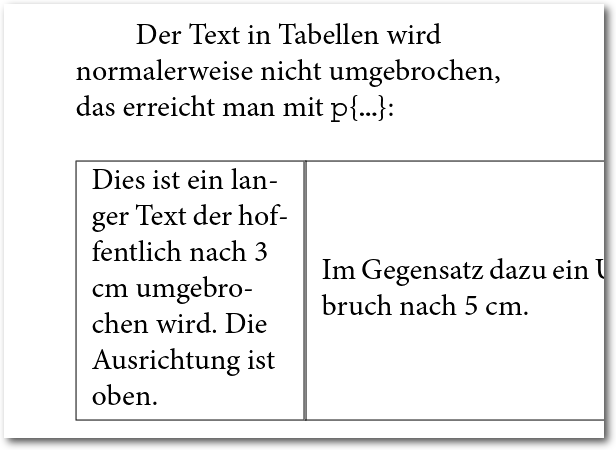

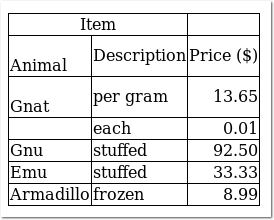

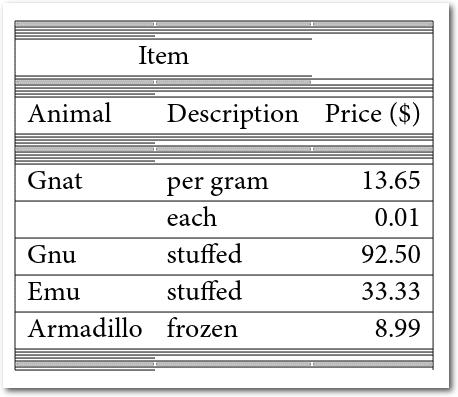

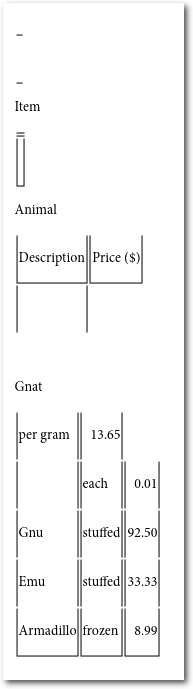

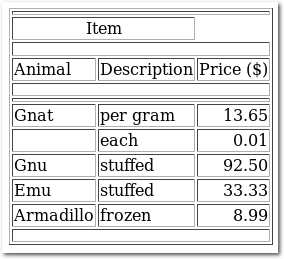

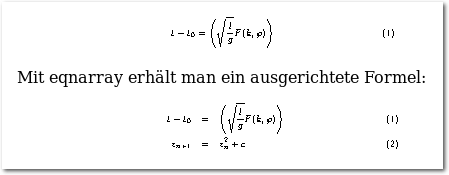

Ein Manko sind bei TtH Tabellen, die leider nur sehr rudimentär

dargestellt werden und nicht wirklich gut aussehen. Dies erfordert

also manuelle Nachbesserung im HTML, wenn diese ordentlich aussehen

sollen. Dafür wird aber auch longtable verstanden, ebenso wie

\tmulticolumn oder Spaltenwiederholungen mit

*{6}{c}.

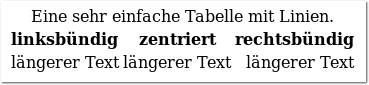

Tabellen mit TtH sehen nicht sehr schön aus.

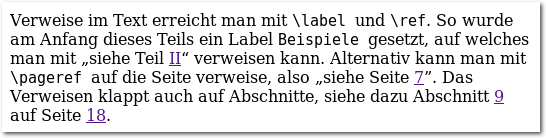

Die Verlinkung im Dokument über Label und Referenzen funktioniert korrekt.

Problematisch sind Referenzen auf Seiten mit \pageref. In einem

HTML-Dokument gibt es keine Seiten, sodass TtH hier als Linktext einfach das Wort

„pageref“ ausgibt. \hyperref wird leider gar nicht unterstützt und der

gesamte Linktext ignoriert.

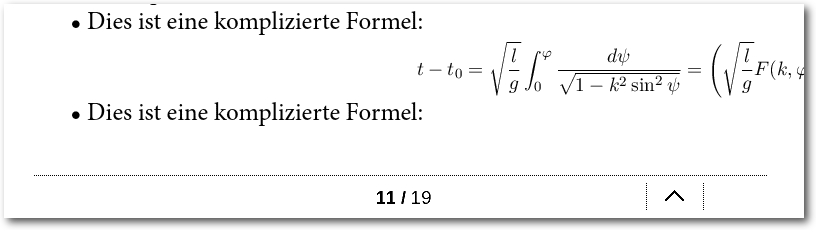

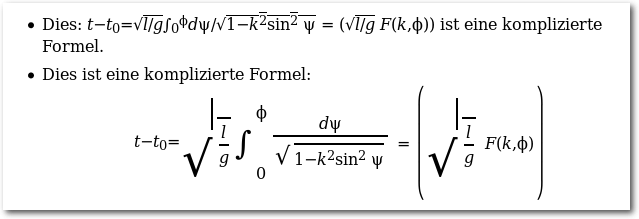

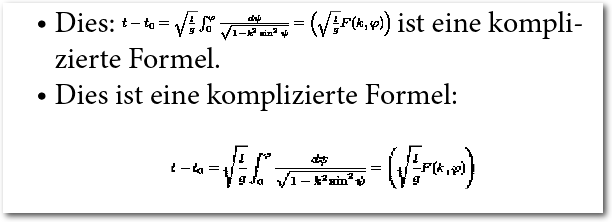

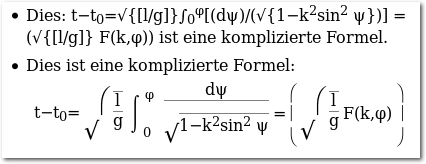

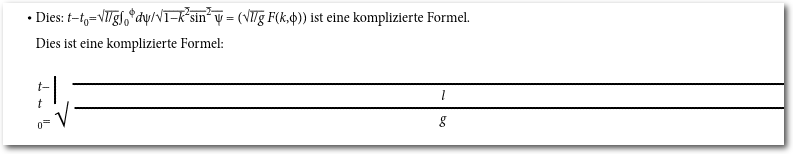

Für viele Anwender sind die mathematische Formeln sehr wichtig. Hier wird

bis auf die align-Umgebung und \mathbb alles verstanden. TtH gibt die

Formeln dabei als Reintext aus und versucht verschiedene Stilelemente für

die Gestaltung zu nutzen, um Brüche, Klammern oder Integrale korrekt

darzustellen. TtM dagegen nutzt wie bereits gesagt MathML, was wesentlich

besser aussieht, aber in einem EPUB nicht funktioniert.

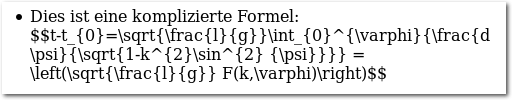

Mathematische Formeln werden mit Sonderzeichen gestaltet.

Zum Schluss werden auch Farben und Zähler unterstützt, ebenso wie

Zitierungen aus dem Quellverzeichnis. Nicht verstanden werden manuelle

Trennungen mit bzw. . Und aus irgendeinem Grund wird ein

vertikaler Strich (Pipe) nicht dargestellt.

Wandlung in EPUB

Nutzt man Calibre bzw. ebook-convert für die Konvertierung wie oben

beschrieben, wird die HTML-Seite fast eins zu eins in das EPUB übernommen,

wobei noch Kleinigkeiten ausgebessert werden, sodass Umlaute korrekt im EPUB

kodiert sind.

Aber auch wenn mit ebook-viewer am PC alles gut im EPUB aussieht, ist

die Darstellung auf einem echten E-Book-Reader ggf. anders,

weswegen die erstellten EPUBs auch real auf einem PocketBook Touch 622

getestet wurden (siehe „Im Test: PocketBook Touch 622“, freiesMagazin

04/2014 [13]).

Es fällt auf, dass der Sans-Serif-Text dennoch Serifen hat, weil die

Schriftart Helvetica, die im HTML dafür allein definiert ist, nicht auf dem

Reader installiert ist.

Was schlimmer wiegt, ist die fehlerhafte Darstellung

der mathematischen Formeln. Diese werden nicht korrekt angezeigt, weil für

die Darstellung Unicode-Zeichen benutzt werden, die auf dem Reader aber

nicht verfügbar sind.

Die Unicode-Zeichen in mathematischen Formeln können nicht überall dargestellt werden.

Pandoc

Pandoc [8] wurde bereits erwähnt,

als es um die Konvertierung von HTML nach EPUB ging. Da hierbei aber

wichtige Textformatierungen und Elemente wie Tabellen nicht übernommen

wurden, stellt sich die Frage, nach einer direkten

Konvertierung von LaTeX nach HTML mit Pandoc.

Pandoc von John MacFarlane ist Open Source und steht für BSD, Linux, MacOS X

und Windows zur Verfügung. Die getestete Version ist 1.13.2 vom 20. Dezember

2014. Die Benutzung nach der Installation ist prinzipiell recht einfach:

$ pandoc --toc -R -s -o beispiel.html beispiel.tex

Die Option --toc erstellt dabei ein Inhaltsverzeichnis, was normalerweise

fehlen würde. -s erzeugt eine Standalone-Ausgabe, sodass eine valide HTML-Seite

erzeugt wird. Zuletzt ist die Option -R wichtig, weil damit auch durch für

Pandoc unverständliche LaTeX-Kommandos gegangen wird. Seltsamerweise führt das

dennoch dazu, dass einige Elemente nicht ausgegeben werden.

Der erste Versuch scheitert aber mit der Meldung:

pandoc:

Error at "input" (line 191, column 1):

unexpected '\n'

Die folgende Aufzählung soll mit römischen Ziffern beginnen. Dies geht aber

^

Leider deutet der Fehler nicht auf das echte Problem hin. Problematisch sind

nämlich die KOMA-Beschreibungslisten mittels labeling. Kommentiert man

diese aus, gibt es aber weitere Problem mit der Definition eigener

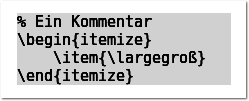

Kommandos. So bringt bei \newenvironment die eingebettete Liste mit

itemize sowie die benutzte enumerate-Aufzählung in einem Kommando

Pandoc durcheinander und bricht den Konvertiervorgang ab. Behebt man diese

drei Stellen durch Auskommentieren, lässt sich das LaTeX-Dokument nach HTML

übersetzen.

Das Ergebnis ist leider nicht sehr befriedigend, was vor allem daran liegt,

dass Pandoc kein \newcommand* und kein \newenvironment versteht. Und

alle unbekannten Makros und Umgebungen hinterlassen mit Pandoc eine Lücke im

HTML-Text, d. h. dass keinerlei Inhalt ausgegeben wird. Das normale

\newcommand ohne Stern wird verstanden, aber es gibt bei manchen

Definitionen Probleme, wie man oben gesehen hat. Wenn man in der Datei

befehle.tex, in der die Befehle für das Beispieldokument stehen, die

Sternchen entfernt und zusätzlich die center-Umgebung bei der

Bildeinbindung auskommentiert, wird wesentlich mehr dargestellt.

Wandlung in HTML

Dennoch ist das resultierende HTML-Dokument nicht sauber konvertiert. Bei

den Schriftformatierungen werden \textsf und \underline komplett

ignoriert. Dafür werden die Kapitälchen korrekt dargestellt. Die Familien

\ttfamily und \sffamily werden ebenfalls ignoriert. Ebenfalls

ungewohnt ist, dass alle Schriftgrößen nicht interpretiert werden.

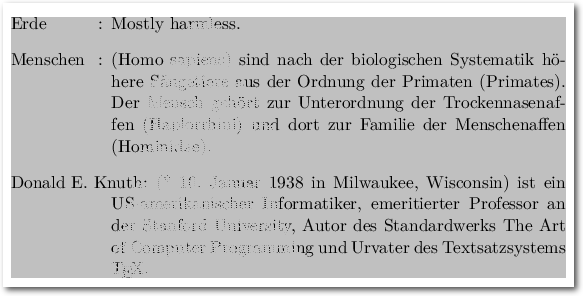

Serifenloser und unterstrichener Text fehlen.

Schön ist dagegen, dass neben Verbatim auch lstlisting verstanden wird.

Textausrichtungen werden auch nicht erkannt, ebenso wie Verweise mit

\label und \ref, was die Verlinkung und Referenzierung innerhalb eines

Dokuments hinfällig macht.

Auch die Unterstützung von Tabellen ist nur rudimentär vorhanden, da

Tabellenlinien gar nicht gedruckt werden. \multicolumn wird ebensowenig

erkannt wie die Definition mehrfacher Spalten oder eigene Definitionen. Auch

longtable ist unbekannt. Die tabular-Umgebung wird erkannt, die

Tabellenunterschrift steht aber über der Tabelle, was etwas ungewohnt

aussieht.

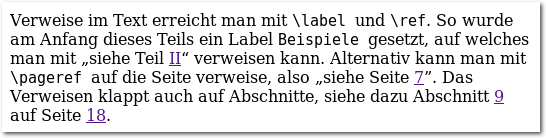

Tabellen werden rudimentär unterstützt, Linien werden nicht angezeigt.